大家好,欢迎来到IT知识分享网。

目录

(1)DAS(直接附加存储,是直接接到计算机的主板总线上去的存储)

(2)NAS(网络附加存储,是通过网络附加到当前主机文件系统之上的存储)

(1)OSD(Object Storage Daemon,守护进程 ceph-osd)

(6)MDS(Metadata Server,守护进程 ceph-mds)

7、 在 admin 管理节点配置 ssh 免密登录所有节点

1、为所有节点都创建一个 Ceph 工作目录,后续的工作都在该目录下进行

2、admin服务器安装 安装 ceph-deploy 部署工具

一:存储基础

1、单机存储设备

(1)DAS(直接附加存储,是直接接到计算机的主板总线上去的存储)

(2)NAS(网络附加存储,是通过网络附加到当前主机文件系统之上的存储)

(3)SAN(存储区域网络)

2、单机存储的问题

(1)存储处理能力不足

传统的IDE的IO值是100次/秒,SATA固态磁盘500次/秒,固态硬盘达到2000-4000次/秒。即使磁盘的IO能力再大数十倍,也不够抗住网站访问高峰期数十万、数百万甚至上亿用户的同时访问,这同时还要受到主机网络IO能力的限制。

(2)存储空间能力不足

单块磁盘的容量再大,也无法满足用户的正常访问所需的数据容量限制。

(3)单点故障问题

单机存储数据存在单点故障问题

3、商业存储解决方案

EMC、NetAPP、IBM、DELL、华为、浪潮

4、分布式存储(软件定义的存储 SDS)

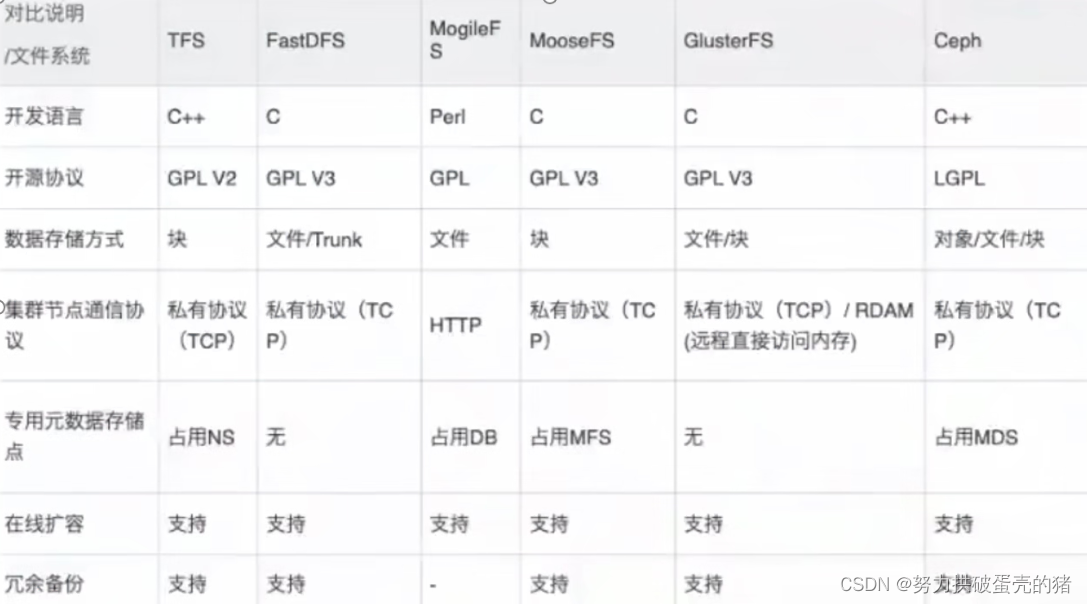

5、分布式存储的类型

(1)块存储

(2)文件存储

(3)对象存储

二:Ceph 介绍

1、Ceph 简介

Ceph使用C++语言开发,是一个开放、自我修复和自我管理的开源分布式存储系统。具有高扩展性、高性能、高可靠性的优点。

2、Ceph 优势

3、Ceph 架构

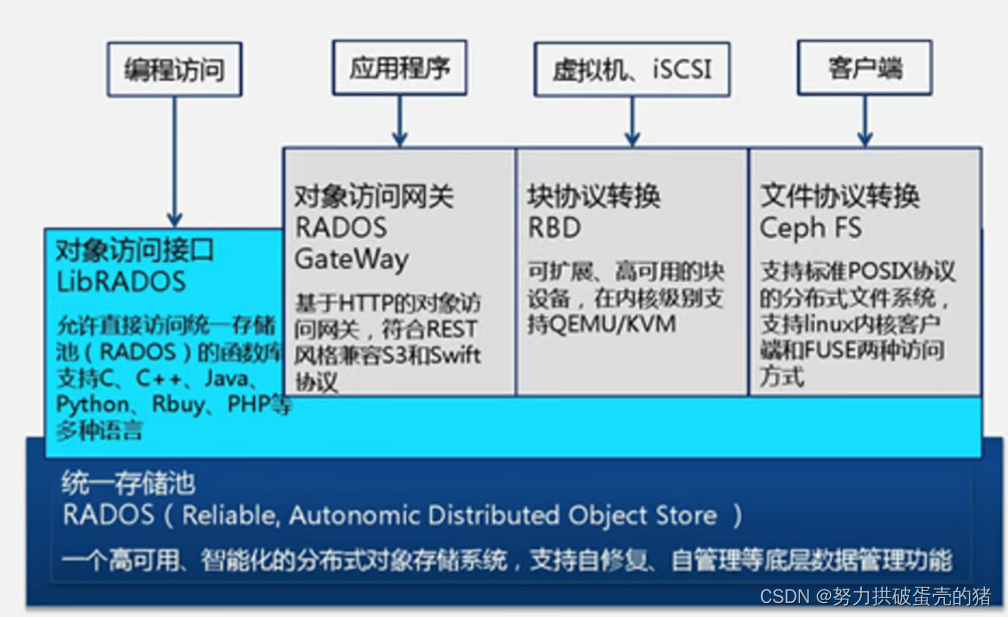

自下向上,可以将Ceph系统分为四个层次:

(1)RADOS 基础存储系统

(2)LIBRADOS 基础库

Librados提供了与RADOS进行交互的方式,并向上层应用提供Ceph服务的API接口,因此上层的RBD、RGW和CephFS都是通过Librados访问的,目前提供PHP、Ruby、Java、Python、Go、C和C++支持,以便直接基于RADOS(而不是整个Ceph)进行客户端应用开发。

(3)高层应用接口

(4)应用层

基于高层接口或者基础库Librados开发出来的各种APP,或者Host、VM等诸多客户端

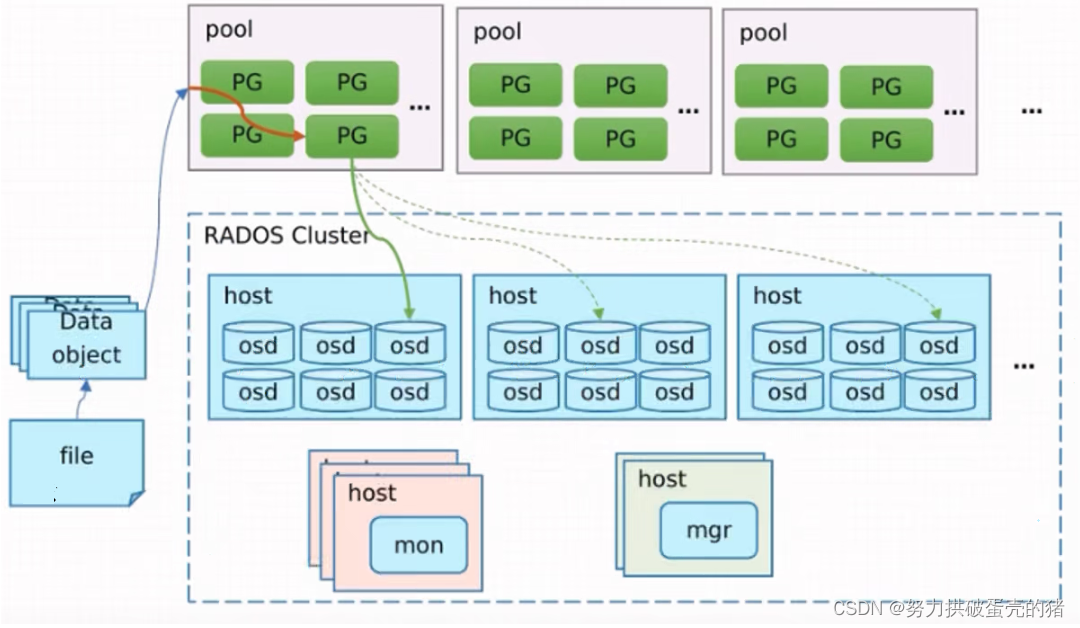

4、Ceph 核心组件

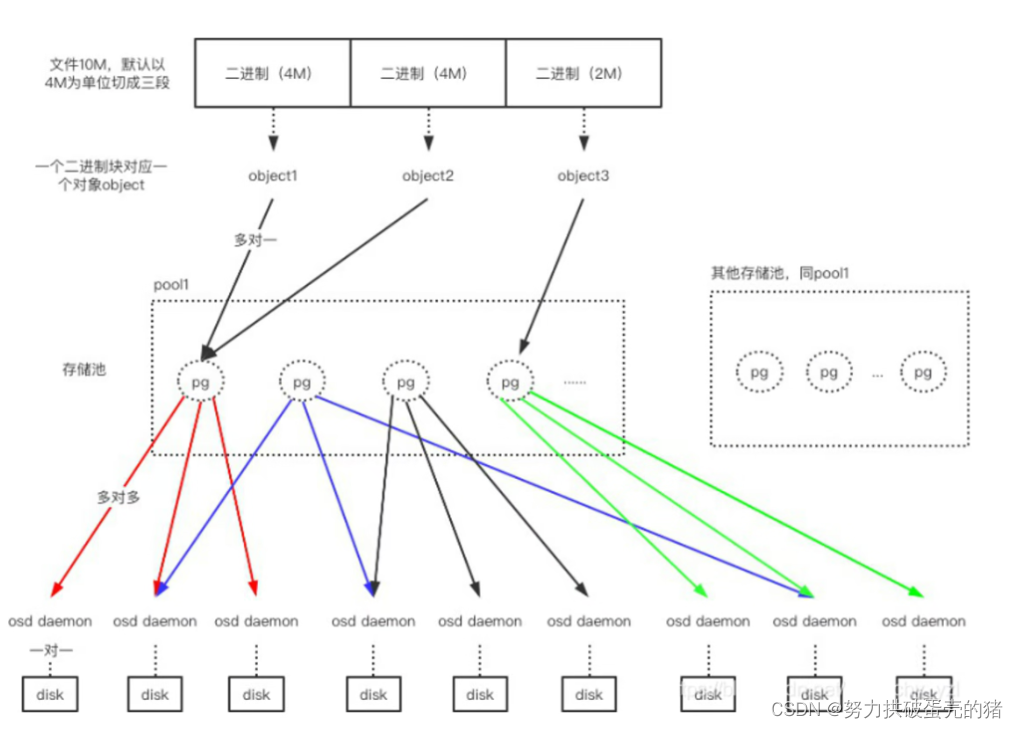

Ceph是一个对象式存储系统,它把每一个待管理的数据流(如文件等数据)切分为一到多个固定大小(默认4兆)的对象数据(Object),并以其为原子单元(原子是构成元素的最小单元)完成数据的读写。

(1)OSD(Object Storage Daemon,守护进程 ceph-osd)

是负责物理存储的进程,一般配置成和磁盘一一对应,一块磁盘启动一个OSD进程。主要功能是存储数据、复制数据、平衡数据、恢复数据,以及与其它OSD间进行心跳检查,负责响应客户端请求返回具体数据的进程等。通常至少需要3个OSD来实现冗余和高可用性。

(2)PG(Placement Group 归置组)

PG 是一个虚拟的概念而已,物理上不真实存在。它在数据寻址时类似于数据库中的索引:Ceph 先将每个对象数据通过HASH算法固定映射到一个 PG 中,然后将 PG 通过 CRUSH 算法映射到 OSD。

(3)Pool

Pool 是存储对象的逻辑分区,它起到 namespace 的作用。每个 Pool 包含一定数量(可配置)的 PG。Pool 可以做故障隔离域,根据不同的用户场景统一进行隔离。

Pool中数据保存方式支持两种类型:

●多副本(replicated):类似 raid1,一个对象数据默认保存 3 个副本,放在不同的 OSD

●纠删码(Erasure Code):类似 raid5,对 CPU 消耗稍大,但是节约磁盘空间,对象数据保存只有 1 个副本。由于Ceph部分功能不支持纠删码池,此类型存储池使用不多

Pool、PG 和 OSD 的关系:

一个Pool里有很多个PG;一个PG里包含一堆对象,一个对象只能属于一个PG;PG有主从之分,一个PG分布在不同的OSD上(针对多副本类型)

(4)Monitor(守护进程 ceph-mon)

用来保存OSD的元数据。负责维护集群状态的映射视图(Cluster Map:OSD Map、Monitor Map、PG Map 和 CRUSH Map),维护展示集群状态的各种图表, 管理集群客户端认证与授权。一个Ceph集群通常至少需要 3 或 5 个(奇数个)Monitor 节点才能实现冗余和高可用性,它们通过 Paxos 协议实现节点间的同步数据。

(5)Manager(守护进程 ceph-mgr)

负责跟踪运行时指标和 Ceph 集群的当前状态,包括存储利用率、当前性能指标和系统负载。为外部监视和管理系统提供额外的监视和接口,例如 zabbix、prometheus、 cephmetrics 等。一个 Ceph 集群通常至少需要 2 个 mgr 节点实现高可用性,基于 raft 协议实现节点间的信息同步。

(6)MDS(Metadata Server,守护进程 ceph-mds)

是 CephFS 服务依赖的元数据服务。负责保存文件系统的元数据,管理目录结构。对象存储和块设备存储不需要元数据服务;如果不使用 CephFS 可以不安装。

5、OSD 存储后端

OSD 有两种方式管理它们存储的数据。在 Luminous 12.2.z 及以后的发行版中,默认(也是推荐的)后端是 BlueStore。在 Luminous 发布之前, 默认是 FileStore, 也是唯一的选项。

(1)Filestore

(2)Bluestore

BlueStore是一个特殊用途的存储后端,专门为OSD工作负载管理磁盘上的数据而设计。BlueStore 的设计是基于十年来支持和管理 Filestore 的经验。BlueStore 相较于 Filestore,具有更好的读写性能和安全性。

6、Ceph 数据的存储过程

1)客户端从 mon 获取最新的 Cluster Map

7、Ceph 版本发行生命周期

Ceph从Nautilus版本(14.2.0)开始,每年都会有一个新的稳定版发行,预计是每年的3月份发布,每年的新版本都会起一个新的名称(例如,“Mimic”)和一个主版本号(例如,13代表Mimic,因为“M”是字母表的第13个字母)。

8、Ceph 集群部署

目前 Ceph 官方提供很多种部署 Ceph 集群的方法,常用的分别是 ceph-deploy,cephadm 和 二进制:

(1)ceph-deploy

一个集群自动化部署工具,使用较久,成熟稳定,被很多自动化工具所集成,可用于生产部署。

(2)cephadm

从 Octopus 和较新的版本版本后使用 cephadm 来部署 ceph 集群,使用容器和 systemd 安装和管理 Ceph 集群。目前不建议用于生产环境。

(3)二进制

手动部署,一步步部署 Ceph 集群,支持较多定制化和了解部署细节,安装难度较大。

三:基于 ceph-deploy 部署 Ceph 集群

1、Ceph 生产环境推荐

2、环境准备

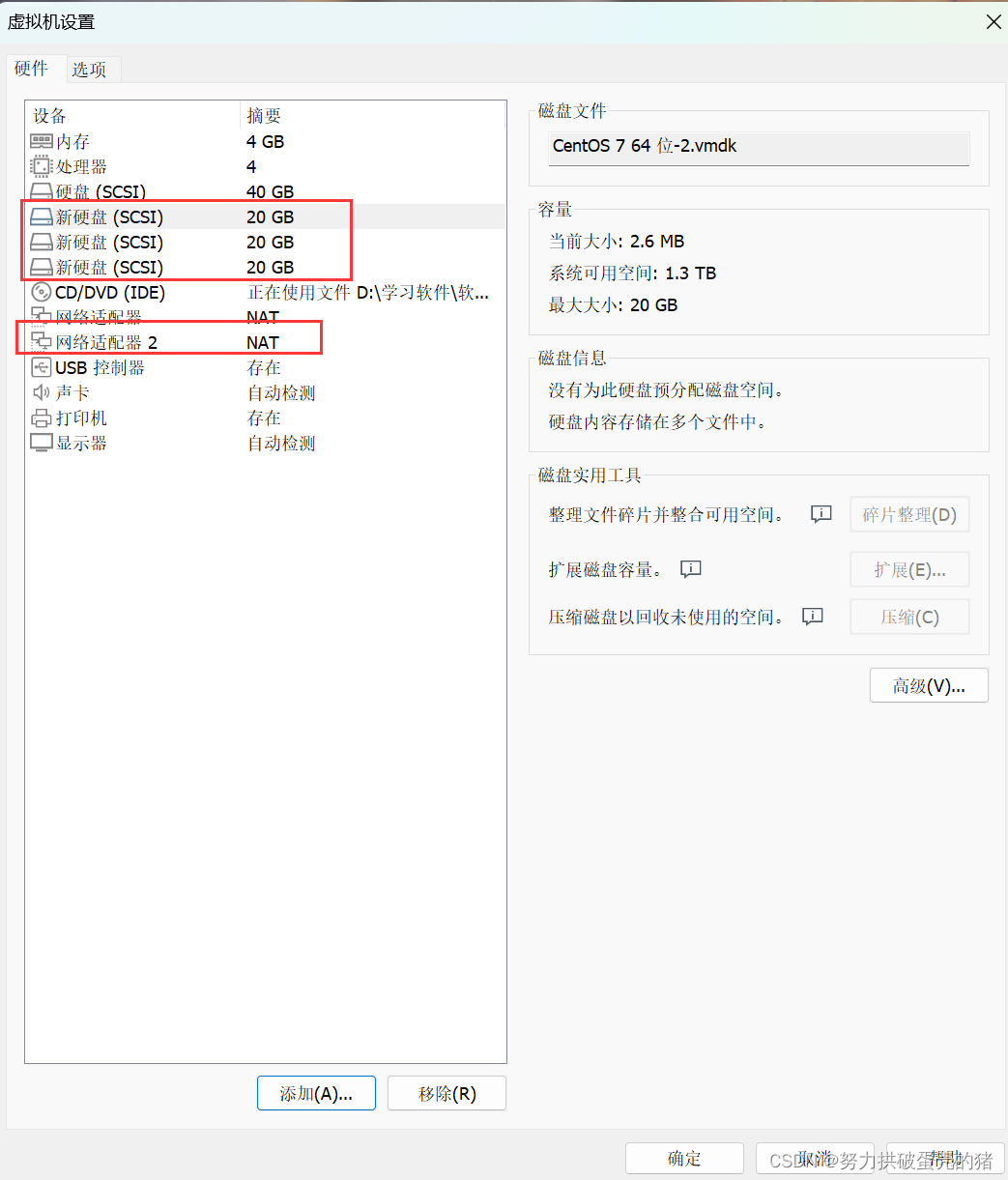

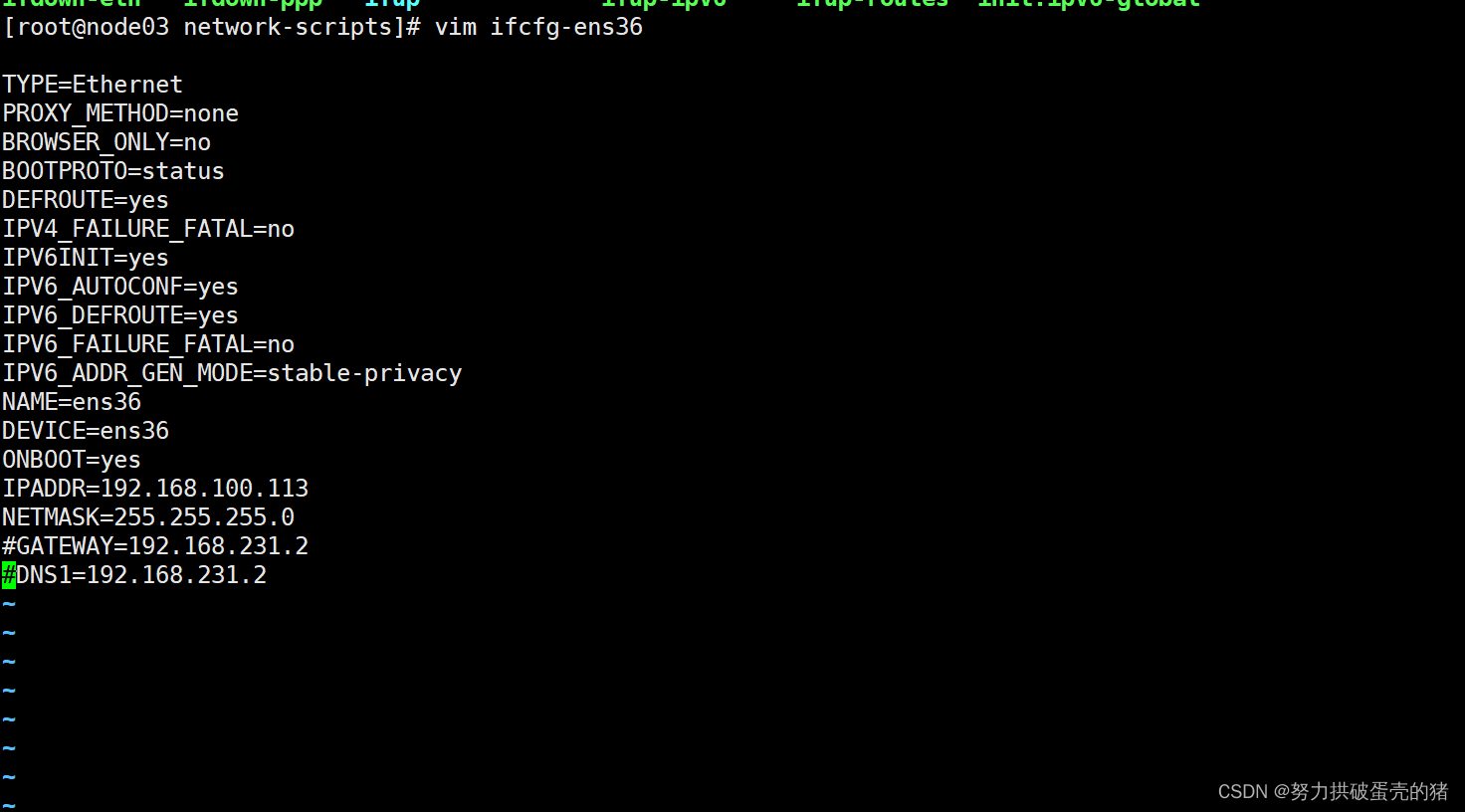

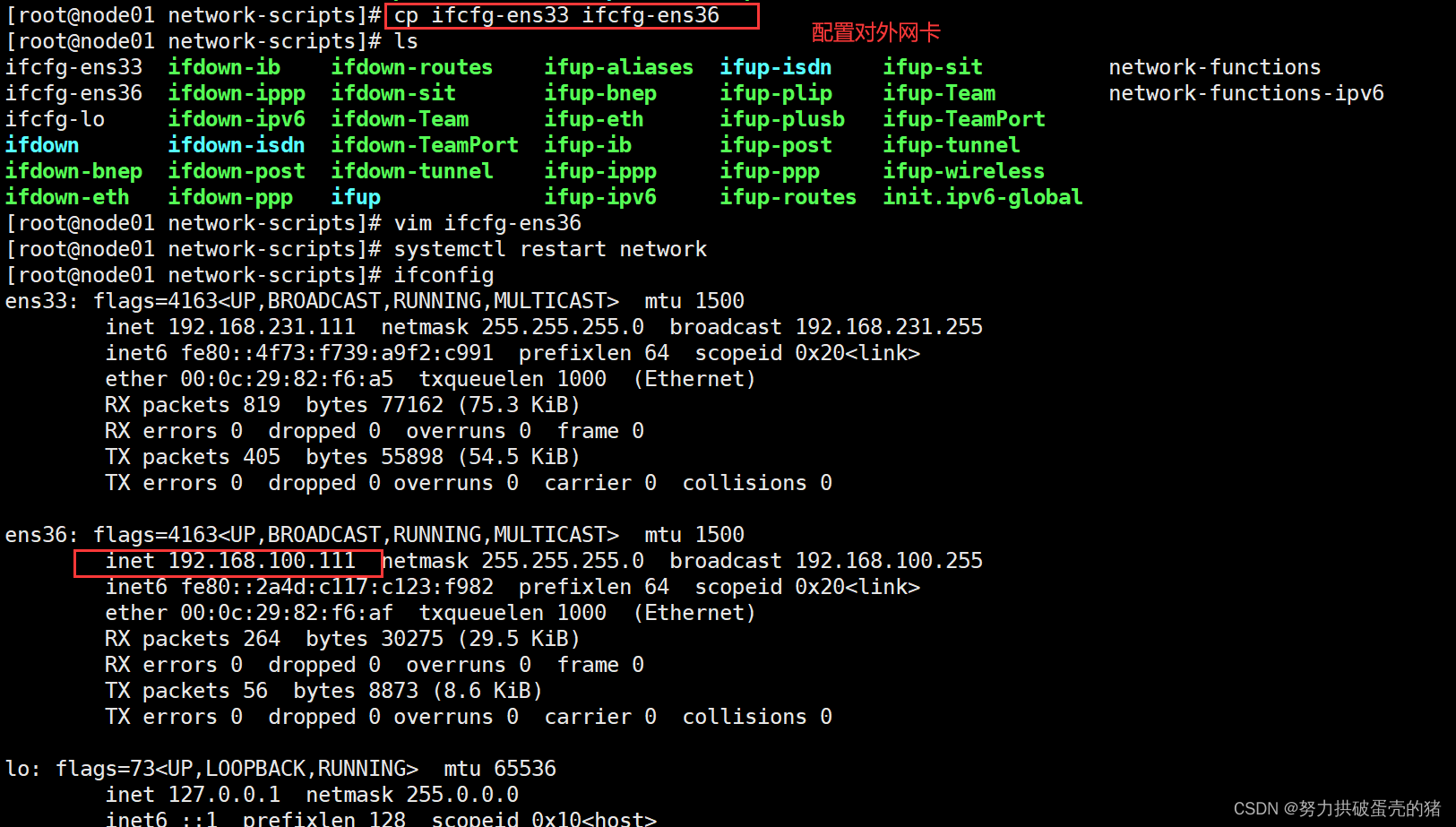

//Ceph 环境规划 主机名 Public网络 Cluster网络 角色 admin 192.168.231.101 admin(管理节点负责集群整体部署)、client node01 192.168.231.111 192.168.100.111 mon、mgr、osd(/dev/sdb、/dev/sdc、/dev/sdd) node02 192.168.231.112 192.168.100.112 mon、mgr、osd(/dev/sdb、/dev/sdc、/dev/sdd) node03 192.168.231.113 192.168.100.113 mon、osd(/dev/sdb、/dev/sdc、/dev/sdd) client 192.168.231.102 client //环境准备 可选步骤:创建 Ceph 的管理用户 useradd cephadm passwd cephadm visudo cephadm ALL=(root) NOPASSWD:ALL 3、关闭 selinux 与防火墙

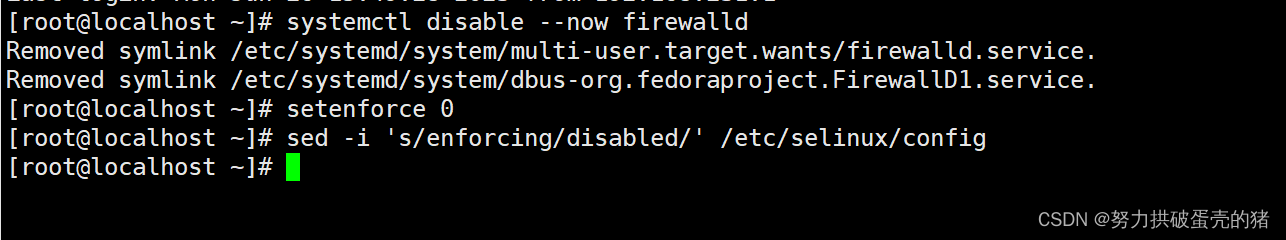

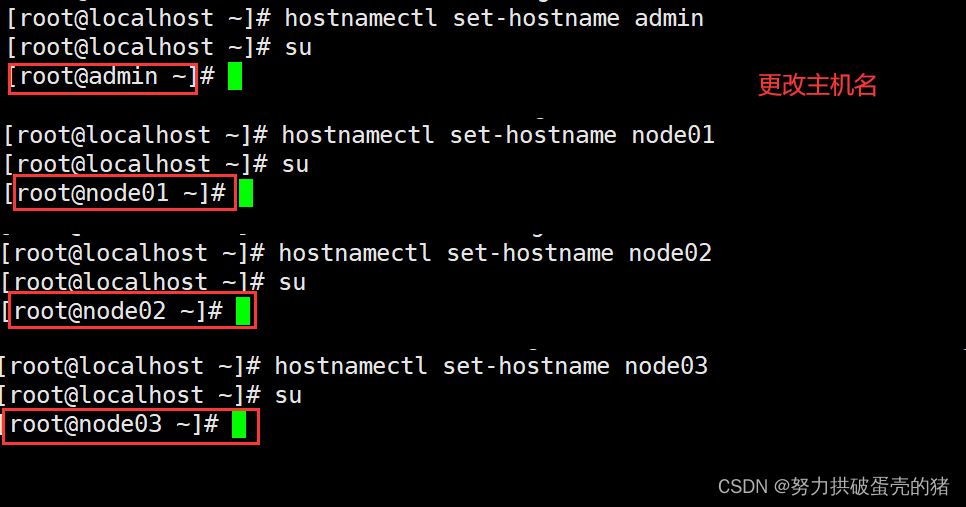

systemctl disable --now firewalld setenforce 0 sed -i 's/enforcing/disabled/' /etc/selinux/config 4、 根据规划设置主机名

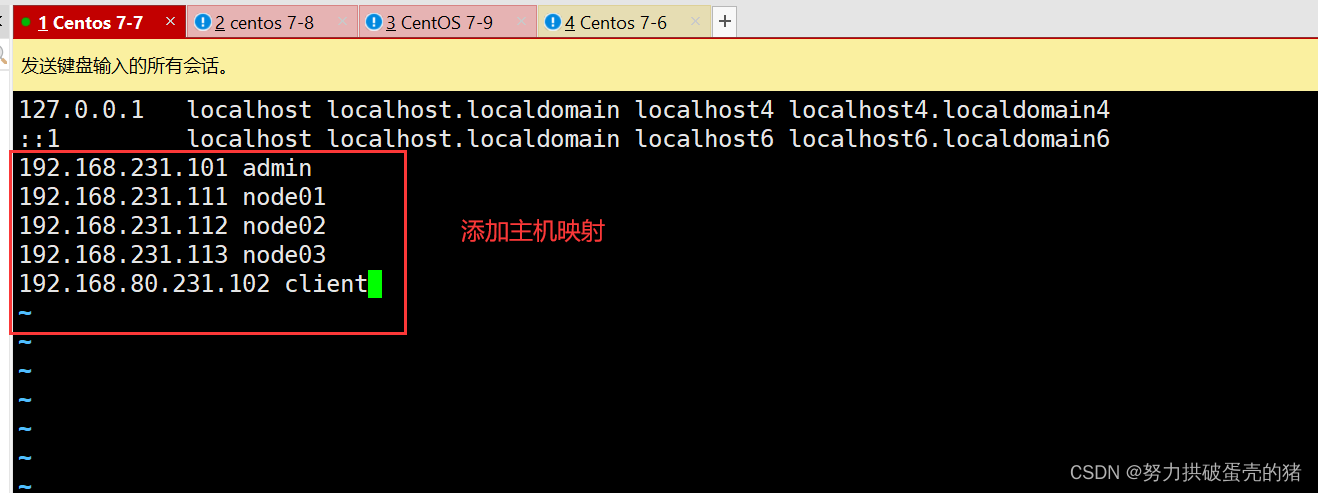

hostnamectl set-hostname admin hostnamectl set-hostname node01 hostnamectl set-hostname node02 hostnamectl set-hostname node03 hostnamectl set-hostname client 5、 配置 hosts 解析

cat >> /etc/hosts << EOF 192.168.231.101 admin 192.168.231.111 node01 192.168.231.112 node02 192.168.231.113 node03 192.168.80.231.102 client EOF6、 安装常用软件和依赖包

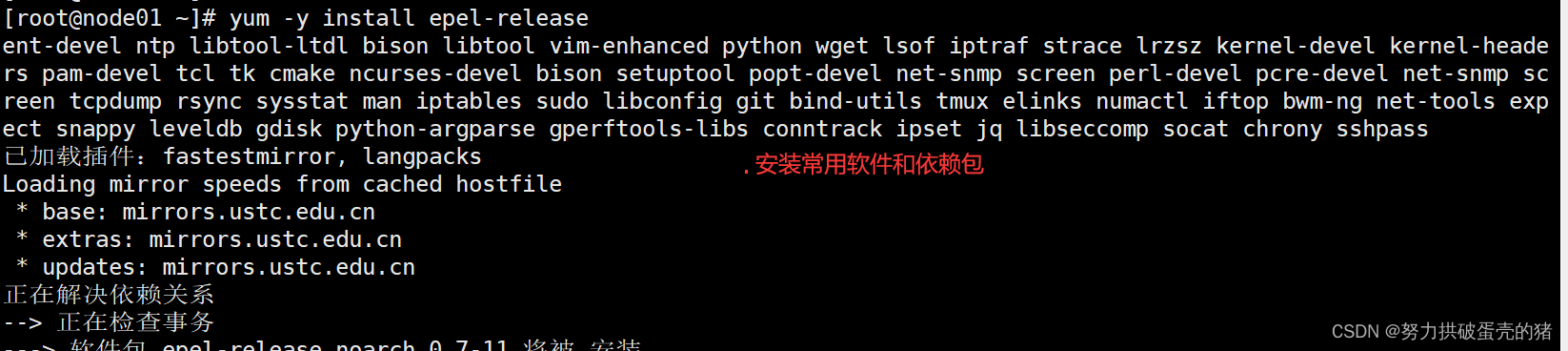

yum -y install epel-release yum -y install yum-plugin-priorities yum-utils ntpdate python-setuptools python-pip gcc gcc-c++ autoconf libjpeg libjpeg-devel libpng libpng-devel freetype freetype-devel libxml2 libxml2-devel zlib zlib-devel glibc glibc-devel glib2 glib2-devel bzip2 bzip2-devel zip unzip ncurses ncurses-devel curl curl-devel e2fsprogs e2fsprogs-devel krb5-devel libidn libidn-devel openssl openssh openssl-devel nss_ldap openldap openldap-devel openldap-clients openldap-servers libxslt-devel libevent-devel ntp libtool-ltdl bison libtool vim-enhanced python wget lsof iptraf strace lrzsz kernel-devel kernel-headers pam-devel tcl tk cmake ncurses-devel bison setuptool popt-devel net-snmp screen perl-devel pcre-devel net-snmp screen tcpdump rsync sysstat man iptables sudo libconfig git bind-utils tmux elinks numactl iftop bwm-ng net-tools expect snappy leveldb gdisk python-argparse gperftools-libs conntrack ipset jq libseccomp socat chrony sshpass 7、 在 admin 管理节点配置 ssh 免密登录所有节点

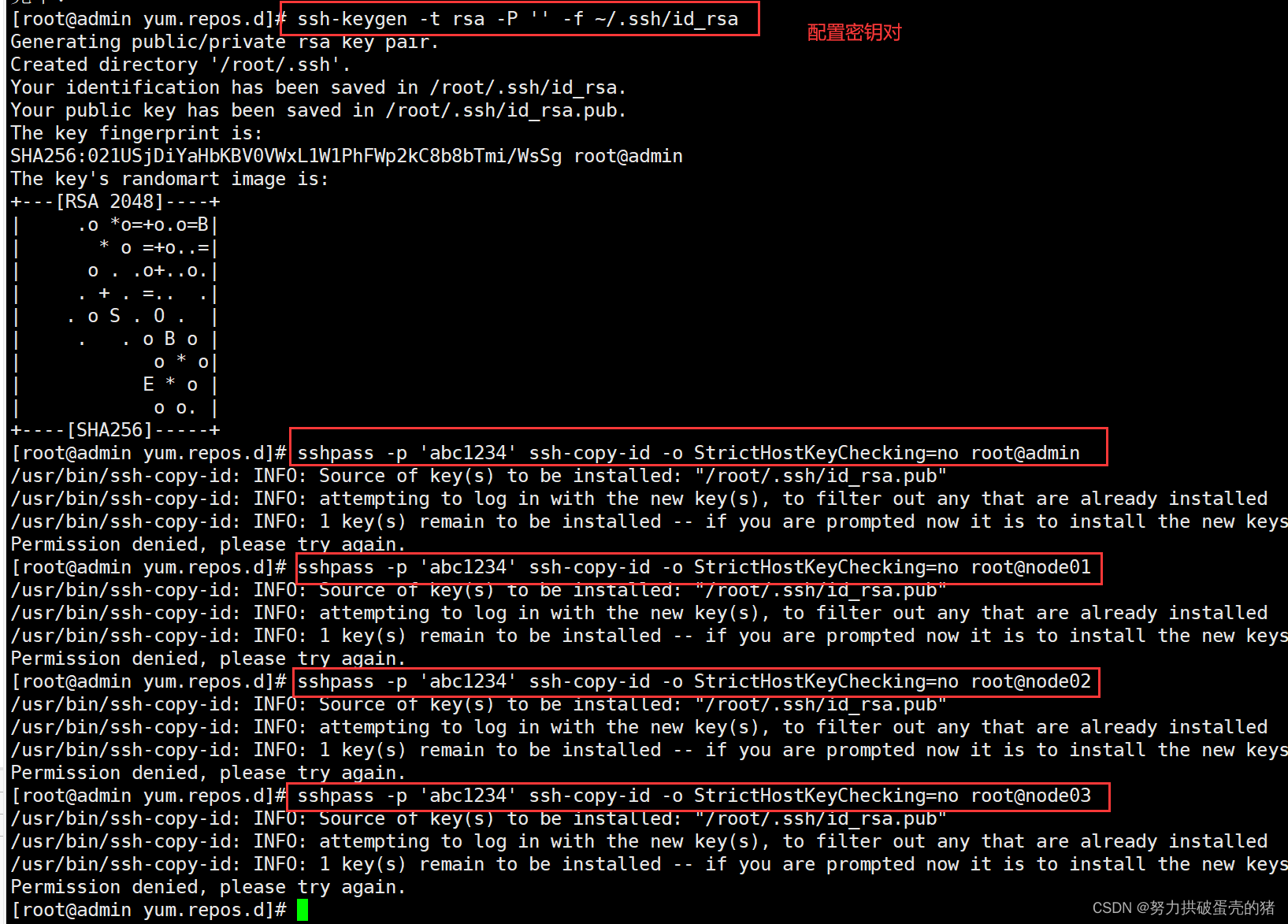

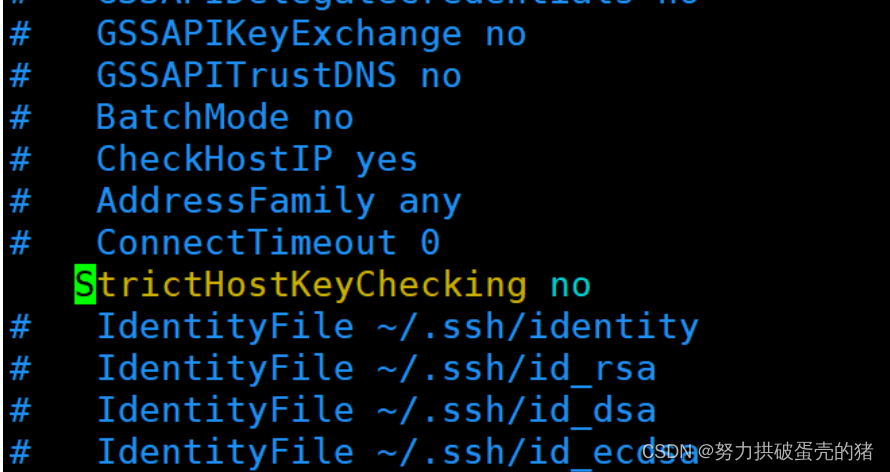

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa sshpass -p 'abc1234' ssh-copy-id -o StrictHostKeyChecking=no root@admin sshpass -p 'abc1234' ssh-copy-id -o StrictHostKeyChecking=no root@node01 sshpass -p 'abc1234' ssh-copy-id -o StrictHostKeyChecking=no root@node02 sshpass -p 'abc1234' ssh-copy-id -o StrictHostKeyChecking=no root@node03 修改配置文件 /etc/ssh/ssh_config中的 StrictHostKeyChecking ask 为 no #35行

8、配置时间同步

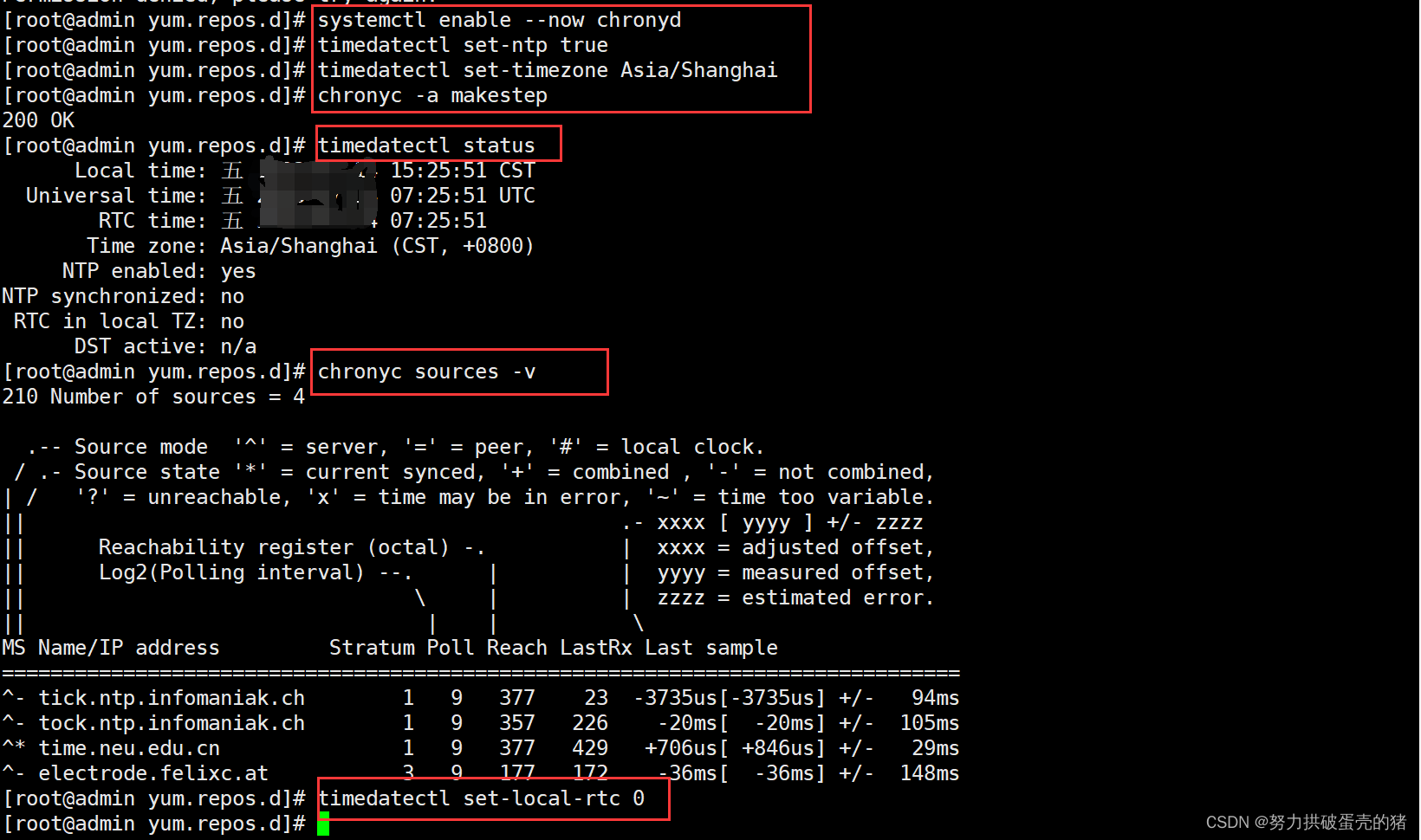

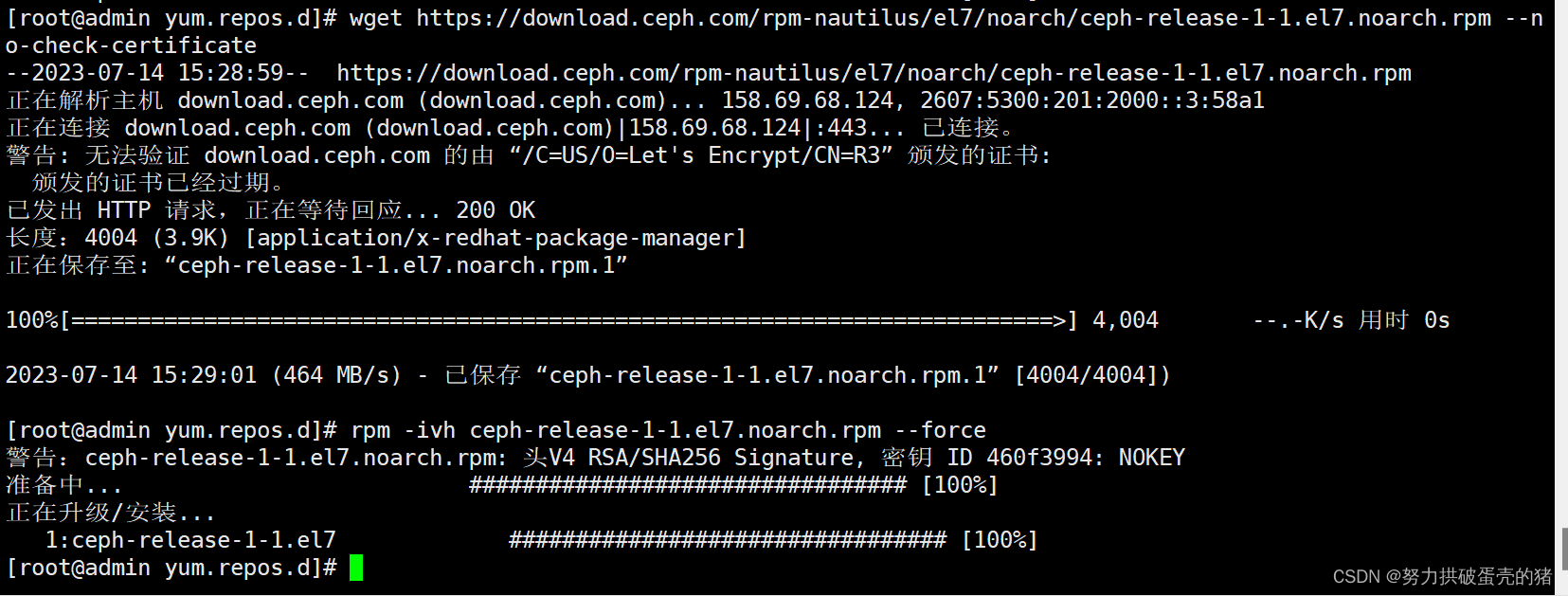

systemctl enable --now chronyd timedatectl set-ntp true #开启 NTP timedatectl set-timezone Asia/Shanghai #设置时区 chronyc -a makestep #强制同步下系统时钟 timedatectl status #查看时间同步状态 chronyc sources -v #查看 ntp 源服务器信息 timedatectl set-local-rtc 0 #将当前的UTC时间写入硬件时钟 #重启依赖于系统时间的服务 systemctl restart rsyslog systemctl restart crond #关闭无关服务 systemctl disable --now postfix 9、配置 Ceph yum源

wget https://download.ceph.com/rpm-nautilus/el7/noarch/ceph-release-1-1.el7.noarch.rpm --no-check-certificate rpm -ivh ceph-release-1-1.el7.noarch.rpm --force 10、执行完上面所有的操作之后重启所有主机(可选)

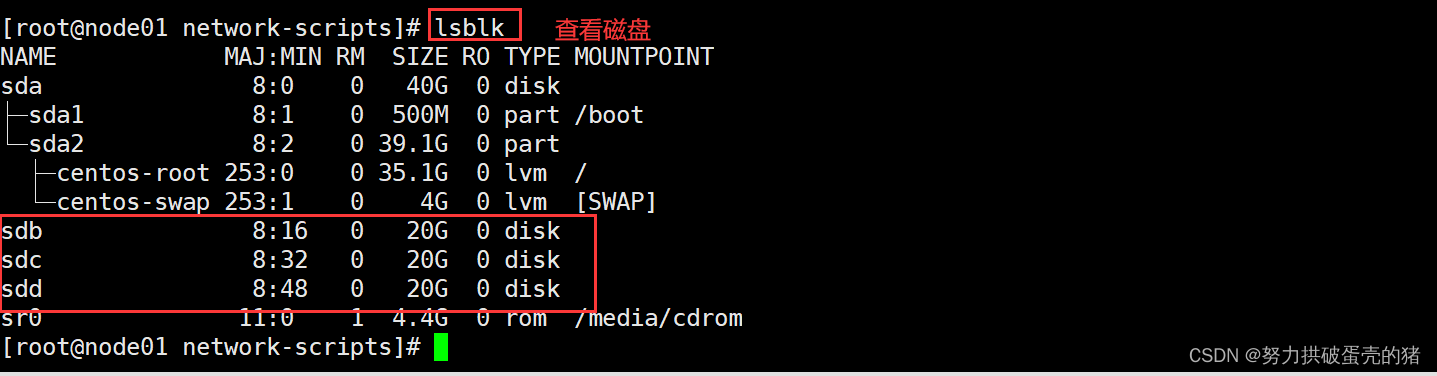

sync reboot #添加完磁盘可以通过重启或以下命令刷新 echo "- - -" > /sys/class/scsi_host/host0/scan echo "- - -" > /sys/class/scsi_host/host1/scan echo "- - -" > /sys/class/scsi_host/host2/scan

四:部署 Ceph 集群

1、为所有节点都创建一个 Ceph 工作目录,后续的工作都在该目录下进行

mkdir -p /etc/ceph2、admin服务器安装 安装 ceph-deploy 部署工具

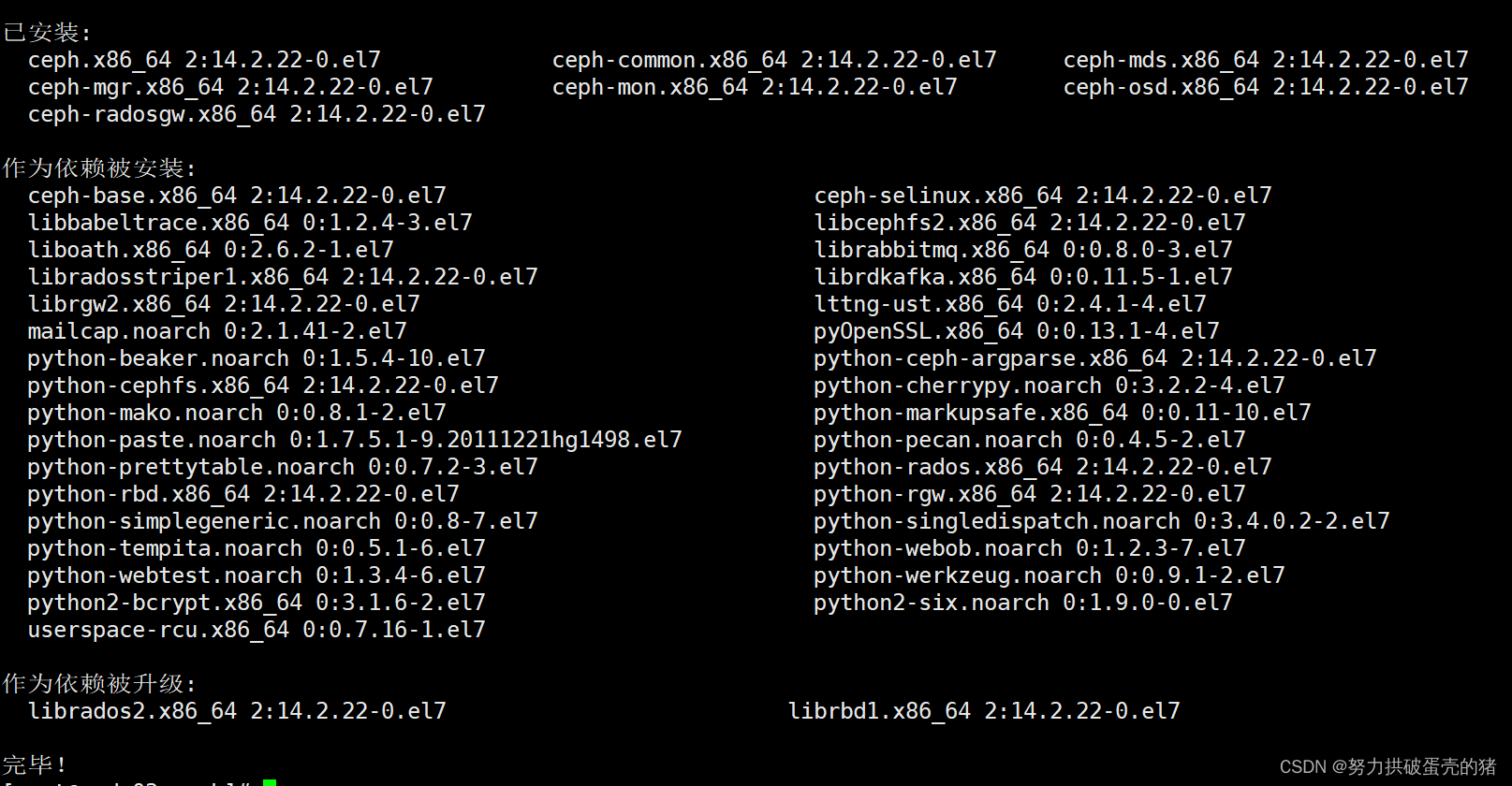

cd /etc/ceph yum install -y ceph-deploy ceph-deploy --version 3、在管理节点为其它节点安装 Ceph 软件包

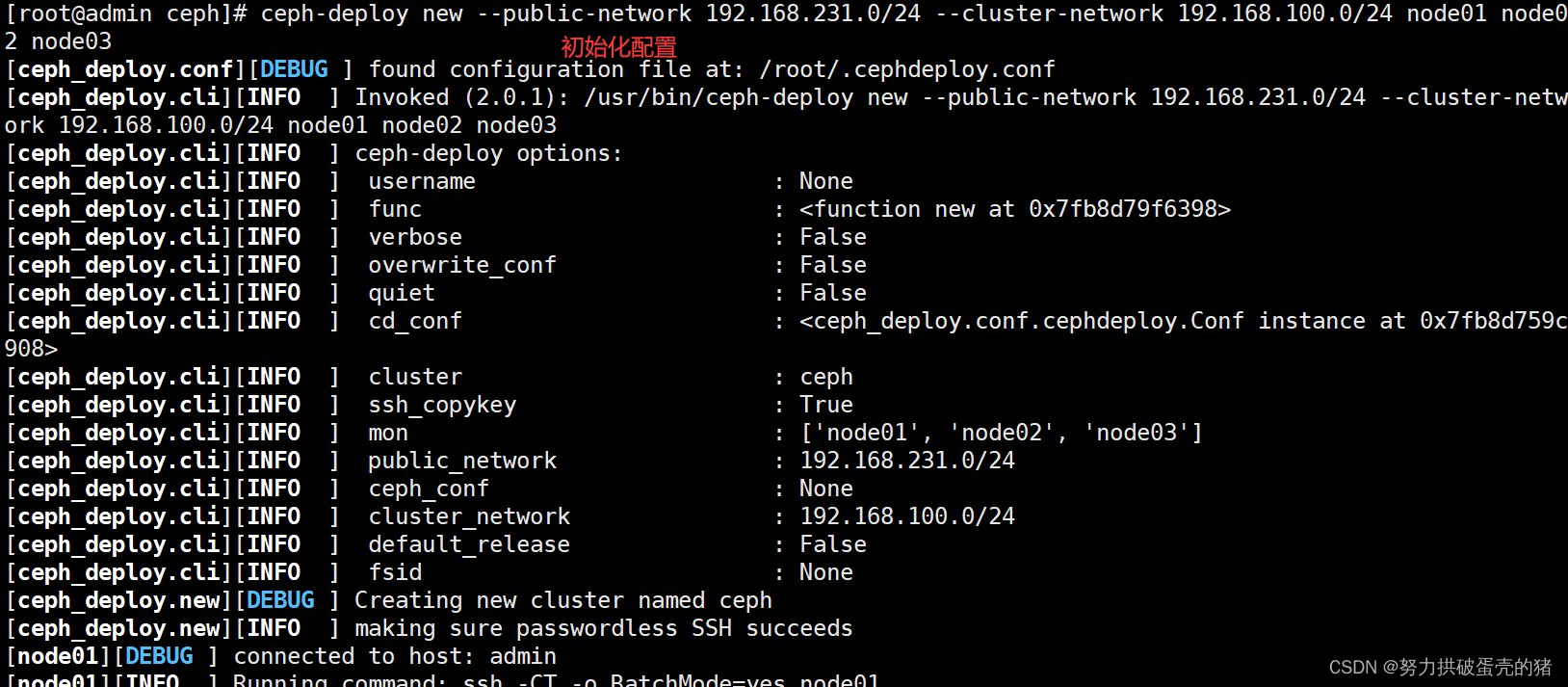

#ceph-deploy 2.0.1 默认部署的是 mimic 版的 Ceph,若想安装其他版本的 Ceph,可以用 --release 手动指定版本 cd /etc/ceph ceph-deploy install --release nautilus node0{1..3} admin #ceph-deploy install 本质就是在执行下面的命令: yum clean all yum -y install epel-release yum -y install yum-plugin-priorities yum -y install ceph-release ceph ceph-radosgw #也可采用手动安装 Ceph 包方式,在其它节点上执行下面的命令将 Ceph 的安装包都部署上: sed -i 's#download.ceph.com#mirrors.tuna.tsinghua.edu.cn/ceph#' /etc/yum.repos.d/ceph.repo yum install -y ceph-mon ceph-radosgw ceph-mds ceph-mgr ceph-osd ceph-common ceph 4、生成初始配置

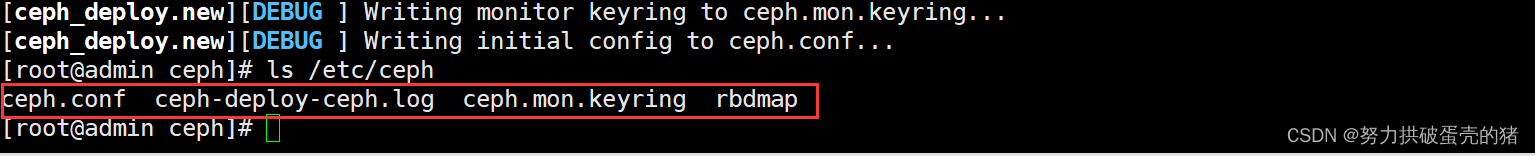

#在管理节点运行下述命令,告诉 ceph-deploy 哪些是 mon 监控节点 cd /etc/ceph ceph-deploy new --public-network 192.168.80.0/24 --cluster-network 192.168.100.0/24 node01 node02 node03 #命令执行成功后会在 /etc/ceph 下生成配置文件 ls /etc/ceph ceph.conf #ceph的配置文件 ceph-deploy-ceph.log #monitor的日志 ceph.mon.keyring #monitor的密钥环文件 5、在管理节点初始化 mon 节点

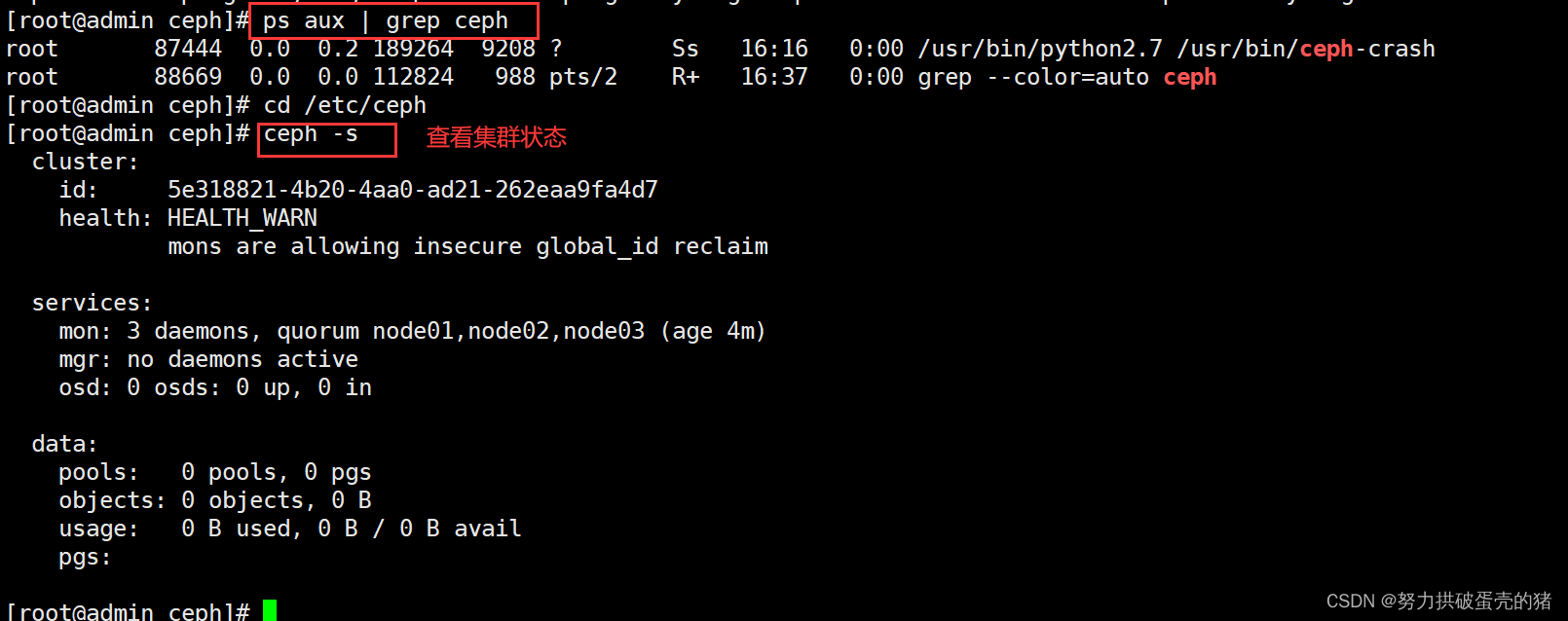

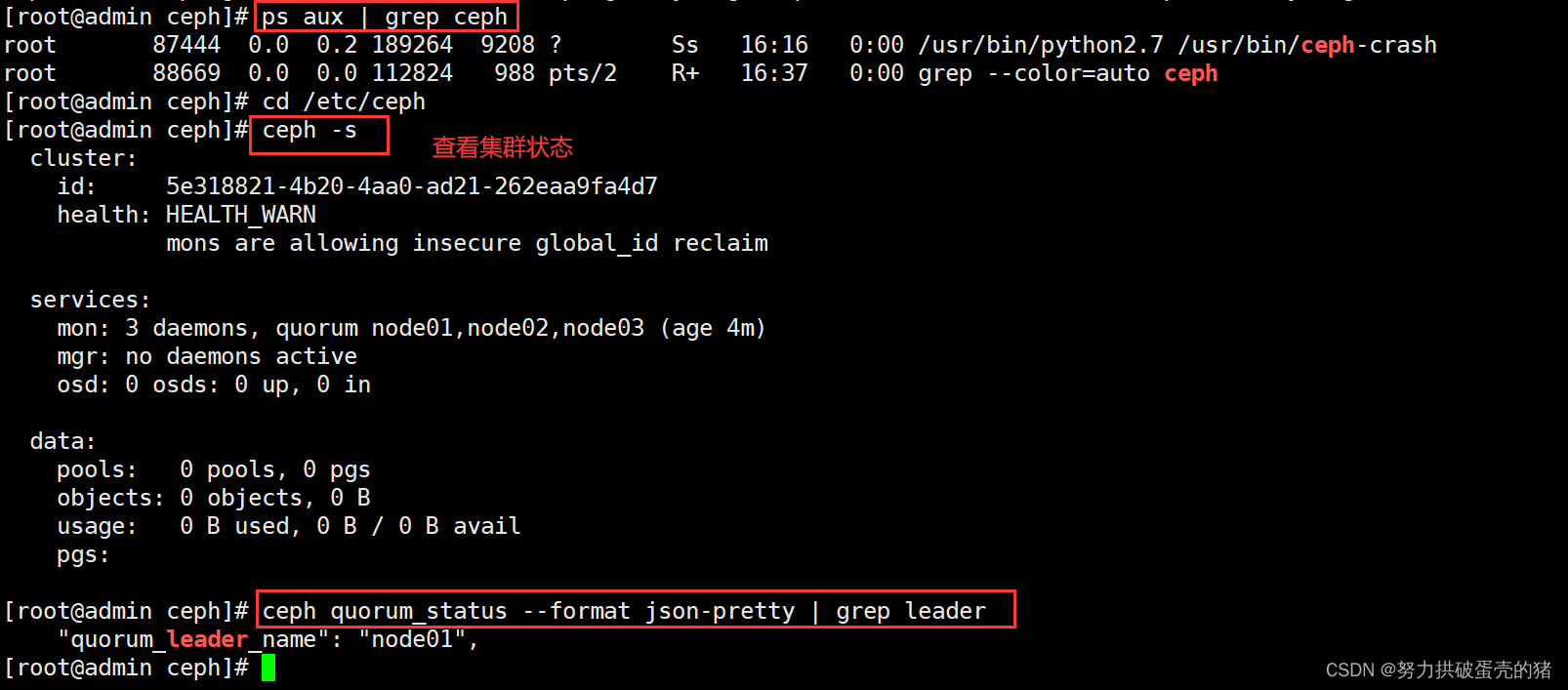

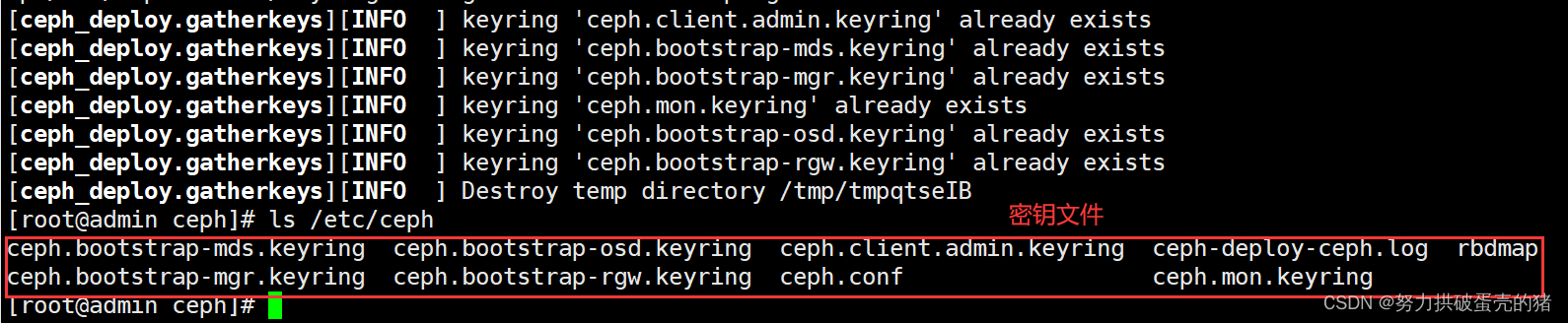

cd /etc/ceph ceph-deploy mon create node01 node02 node03 #创建 mon 节点,由于 monitor 使用 Paxos 算法,其高可用集群节点数量要求为大于等于 3 的奇数台 #节点配置如果和管理配置文件不一致,强行同步配置 ceph-deploy --overwrite-conf mon create-initial #配置初始化 mon 节点,并向所有节点同步配置 # --overwrite-conf 参数用于表示强制覆盖配置文件 ceph-deploy gatherkeys node01 #可选操作,向 node01 节点收集所有密钥 #命令执行成功后会在 /etc/ceph 下生成配置文件 ls /etc/ceph ceph.bootstrap-mds.keyring #引导启动 mds 的密钥文件 ceph.bootstrap-mgr.keyring #引导启动 mgr 的密钥文件 ceph.bootstrap-osd.keyring #引导启动 osd 的密钥文件 ceph.bootstrap-rgw.keyring #引导启动 rgw 的密钥文件 ceph.client.admin.keyring #ceph客户端和管理端通信的认证密钥,拥有ceph集群的所有权限 ceph.conf ceph-deploy-ceph.log ceph.mon.keyring #在 mon 节点上查看自动开启的 mon 进程 ps aux | grep ceph root 1823 0.0 0.2 9216 ? Ss 19:46 0:00 /usr/bin/python2.7 /usr/bin/ceph-crash ceph 3228 0.0 0.8 33420 ? Ssl 21:08 0:00 /usr/bin/ceph-mon -f --cluster ceph --id node03 --setuser ceph --setgroupceph root 3578 0.0 0.0 988 pts/1 R+ 21:24 0:00 grep --color=auto ceph #在管理节点查看 Ceph 集群状态 cd /etc/ceph ceph -s cluster: id: 7e9848bb-909c-43fa-b36c-5805ffbbeb39 health: HEALTH_WARN mons are allowing insecure global_id reclaim services: mon: 3 daemons, quorum node01,node02,node03 mgr: no daemons active osd: 0 osds: 0 up, 0 in data: pools: 0 pools, 0 pgs objects: 0 objects, 0 B usage: 0 B used, 0 B / 0 B avail pgs: #查看 mon 集群选举的情况 ceph quorum_status --format json-pretty | grep leader "quorum_leader_name": "node01", #扩容 mon 节点 ceph-deploy mon add <节点名称>

6、部署能够管理 Ceph 集群的节点(可选)

#可实现在各个节点执行 ceph 命令管理集群 cd /etc/ceph ceph-deploy --overwrite-conf config push node01 node02 node03 #向所有 mon 节点同步配置,确保所有 mon 节点上的 ceph.conf 内容必须一致 ceph-deploy admin node01 node02 node03 #本质就是把 ceph.client.admin.keyring 集群认证文件拷贝到各个节点 #在 mon 节点上查看 ls /etc/ceph ceph.client.admin.keyring ceph.conf rbdmap tmpr8tzyc cd /etc/ceph ceph -s 7、部署 osd 存储节点,管理节点操作

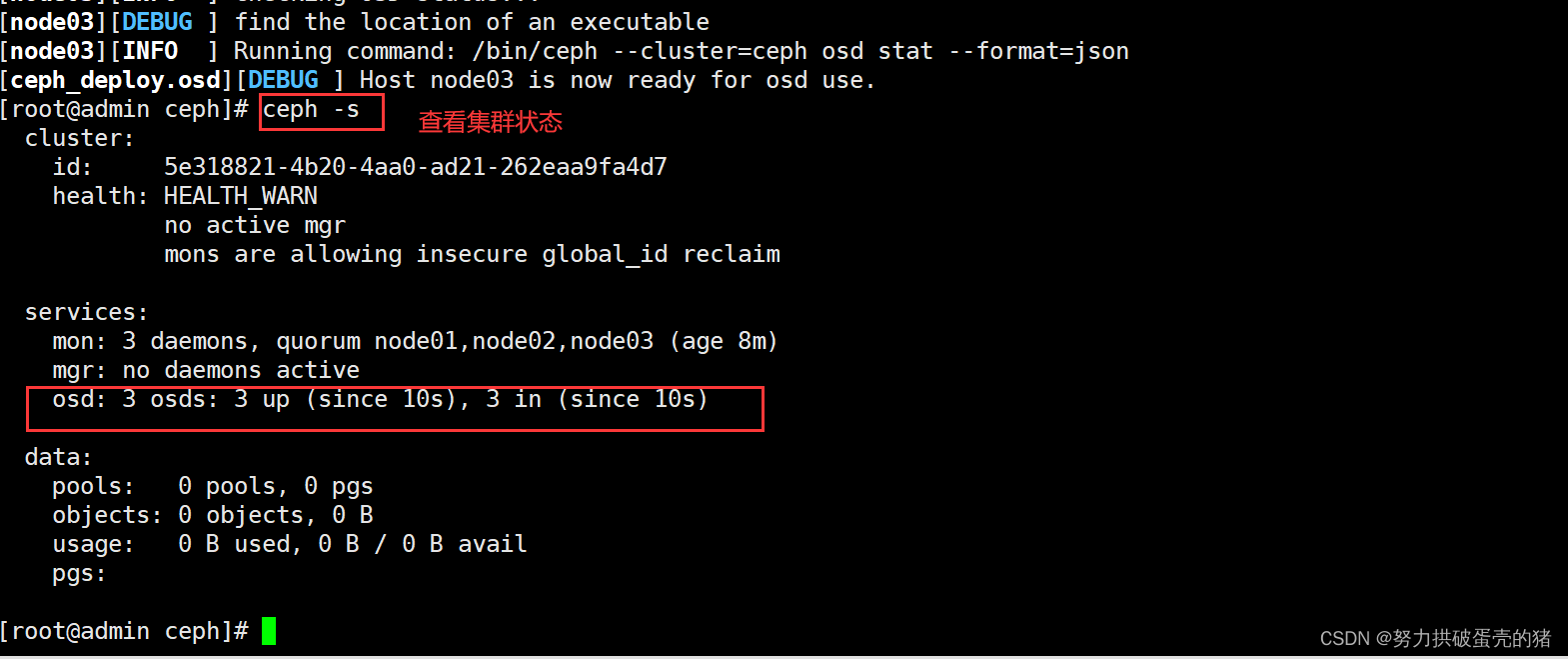

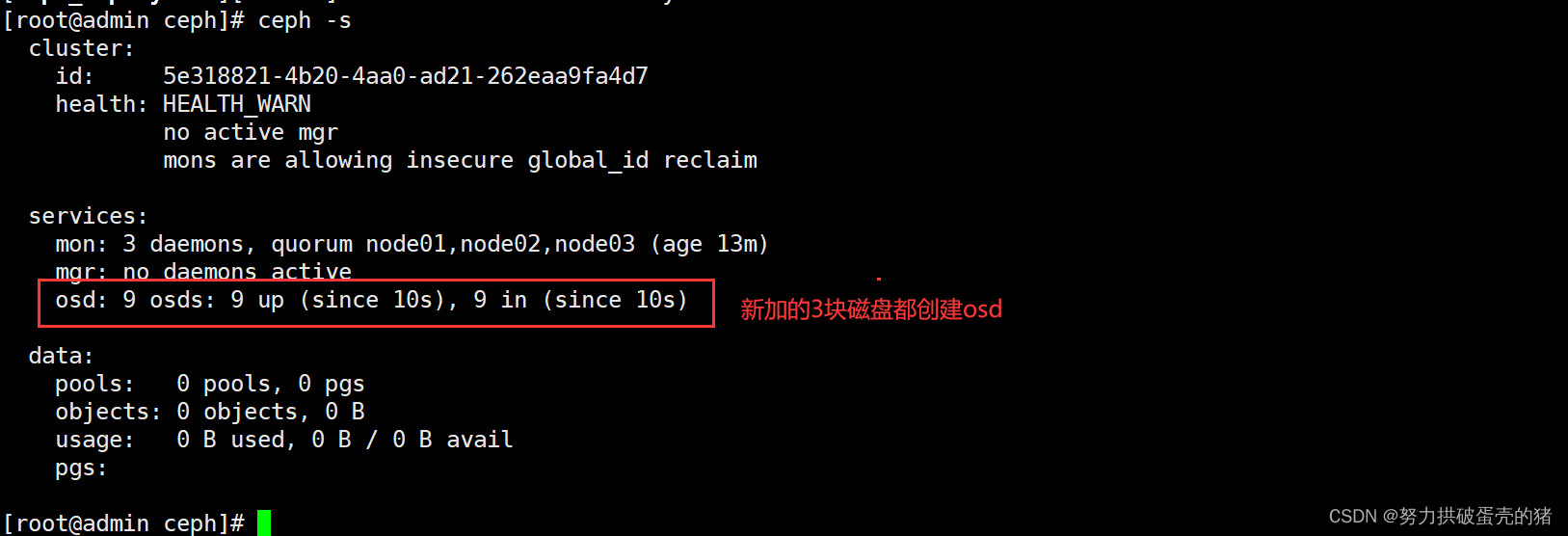

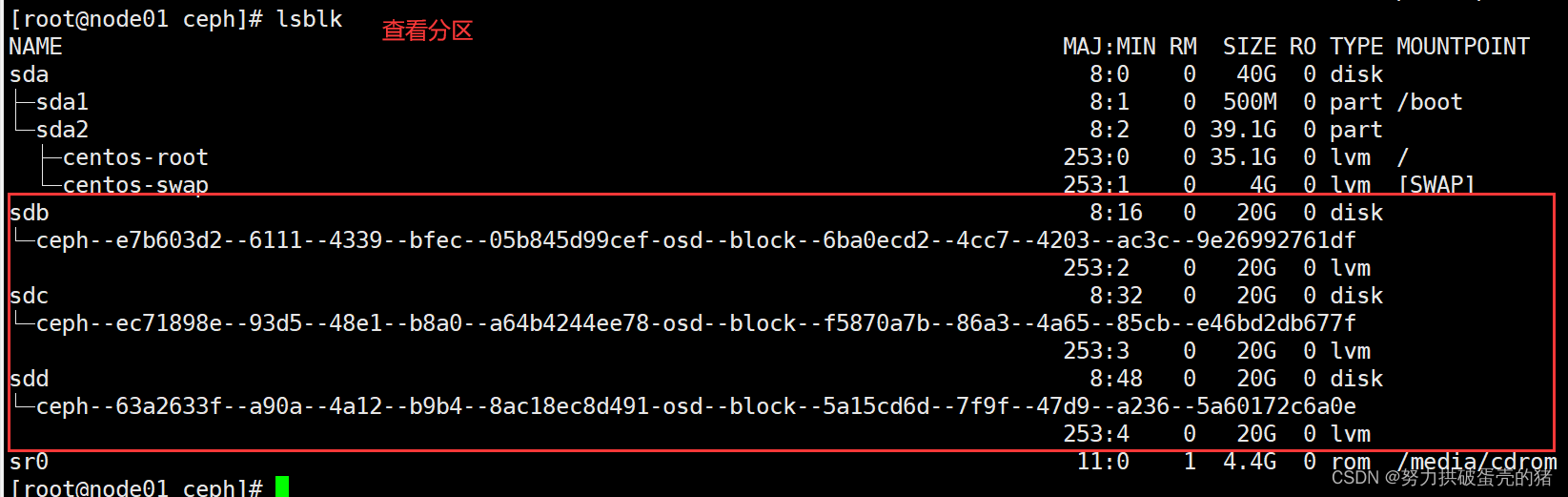

#主机添加完硬盘后不要分区,直接使用 lsblk NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT sda 8:0 0 60G 0 disk ├─sda1 8:1 0 500M 0 part /boot ├─sda2 8:2 0 4G 0 part [SWAP] └─sda3 8:3 0 55.5G 0 part / sdb 8:16 0 20G 0 disk sdc 8:32 0 20G 0 disk sdd 8:48 0 20G 0 disk #如果是利旧的硬盘,则需要先擦净(删除分区表)磁盘(可选,无数据的新硬盘可不做) cd /etc/ceph ceph-deploy disk zap node01 /dev/sdb ceph-deploy disk zap node02 /dev/sdb ceph-deploy disk zap node03 /dev/sdb #添加 osd 节点 ceph-deploy --overwrite-conf osd create node01 --data /dev/sdb ceph-deploy --overwrite-conf osd create node02 --data /dev/sdb ceph-deploy --overwrite-conf osd create node03 --data /dev/sdb #查看 ceph 集群状态 ceph -s cluster: id: 7e9848bb-909c-43fa-b36c-5805ffbbeb39 health: HEALTH_WARN no avtive mgr services: mon: 3 daemons, quorum node01,node02,node03 (age 119m) mgr: no daemons active osd: 3 osds: 3 up (since 35s), 3 in (since 35s) data: pools: 0 pools, 0 pgs objects: 0 objects, 0 B usage: 3.0 GiB used, 57 GiB / 60 GiB avail pgs: ceph osd stat ceph osd tree rados df #节点查询状态 ssh root@node01 systemctl status ceph-osd@0 ssh root@node02 systemctl status ceph-osd@1 ssh root@node03 systemctl status ceph-osd@2 ceph osd status #查看 osd 状态,需部署 mgr 后才能执行 +----+--------+-------+-------+--------+---------+--------+---------+-----------+ | id | host | used | avail | wr ops | wr data | rd ops | rd data | state | +----+--------+-------+-------+--------+---------+--------+---------+-----------+ | 0 | node01 | 1025M | 18.9G | 0 | 0 | 0 | 0 | exists,up | | 1 | node02 | 1025M | 18.9G | 0 | 0 | 0 | 0 | exists,up | | 2 | node03 | 1025M | 18.9G | 0 | 0 | 0 | 0 | exists,up | +----+--------+-------+-------+--------+---------+--------+---------+-----------+ ceph osd df #查看 osd 容量,需部署 mgr 后才能执行 ID CLASS WEIGHT REWEIGHT SIZE RAW USE DATA OMAP META AVAIL %USE VAR PGS STATUS 0 hdd 0.01949 1.00000 20 GiB 1.0 GiB 1.8 MiB 0 B 1 GiB 19 GiB 5.01 1.00 0 up 1 hdd 0.01949 1.00000 20 GiB 1.0 GiB 1.8 MiB 0 B 1 GiB 19 GiB 5.01 1.00 0 up 2 hdd 0.01949 1.00000 20 GiB 1.0 GiB 1.8 MiB 0 B 1 GiB 19 GiB 5.01 1.00 0 up TOTAL 60 GiB 3.0 GiB 5.2 MiB 0 B 3 GiB 57 GiB 5.01 MIN/MAX VAR: 1.00/1.00 STDDEV: 0 #扩容 osd 节点 cd /etc/ceph ceph-deploy --overwrite-conf osd create node01 --data /dev/sdc ceph-deploy --overwrite-conf osd create node02 --data /dev/sdc ceph-deploy --overwrite-conf osd create node03 --data /dev/sdc ceph-deploy --overwrite-conf osd create node01 --data /dev/sdd ceph-deploy --overwrite-conf osd create node02 --data /dev/sdd ceph-deploy --overwrite-conf osd create node03 --data /dev/sdd 添加 OSD 中会涉及到 PG 的迁移,由于此时集群并没有数据,因此 health 的状态很快就变成 OK,如果在生产环境中添加节点则会涉及到大量的数据的迁移。 8、部署 mgr 节点

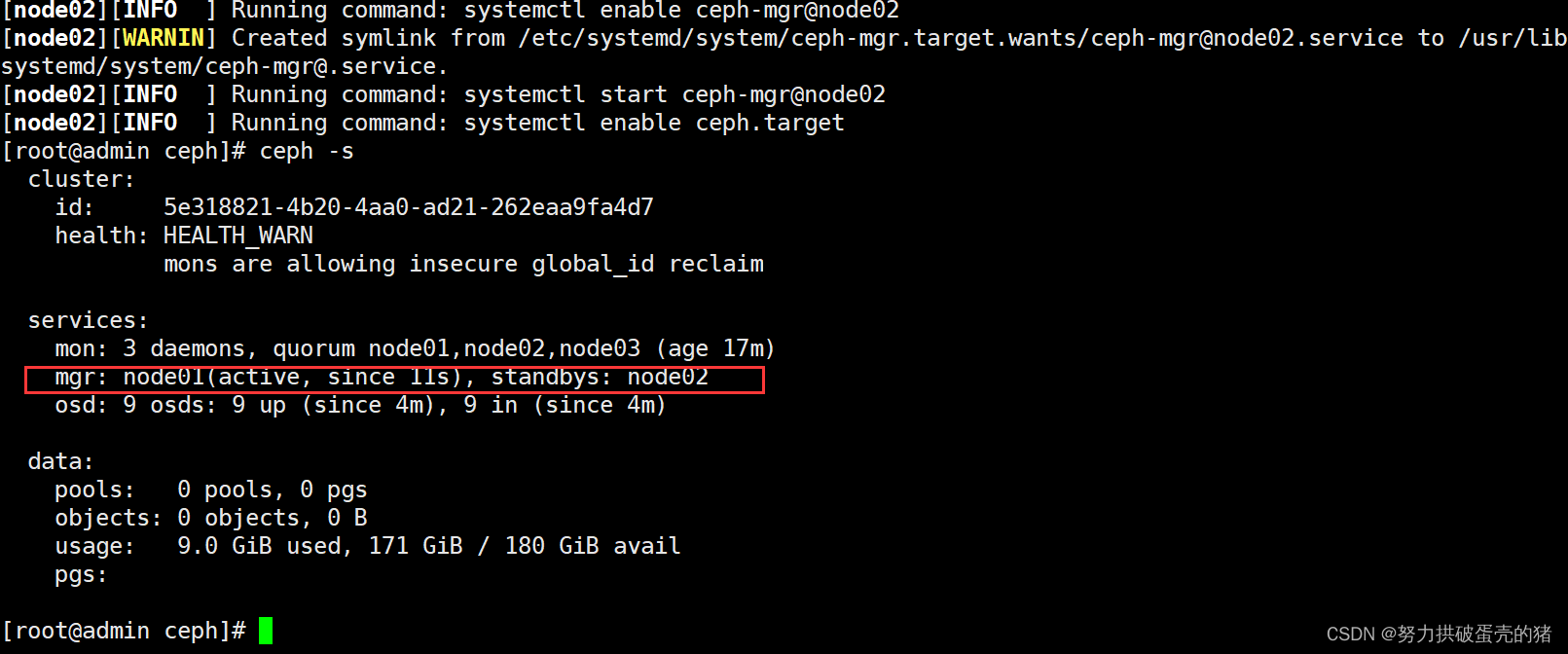

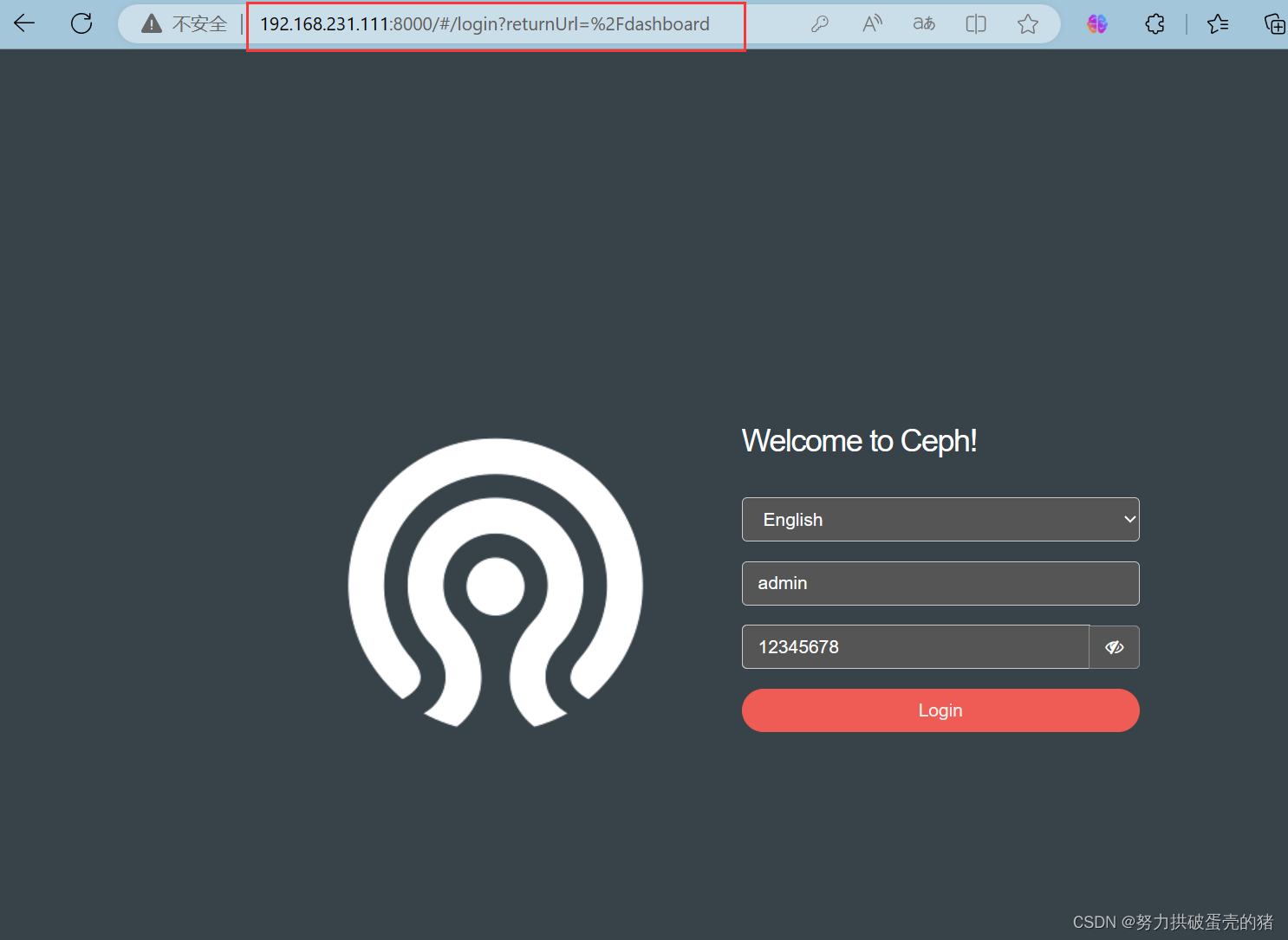

#ceph-mgr守护进程以Active/Standby模式运行,可确保在Active节点或其ceph-mgr守护进程故障时,其中的一个Standby实例可以在不中断服务的情况下接管其任务。根据官方的架构原则,mgr至少要有两个节点来进行工作。 cd /etc/ceph ceph-deploy mgr create node01 node02 ceph -s cluster: id: 7e9848bb-909c-43fa-b36c-5805ffbbeb39 health: HEALTH_WARN mons are allowing insecure global_id reclaim services: mon: 3 daemons, quorum node01,node02,node03 mgr: node01(active, since 10s), standbys: node02 osd: 0 osds: 0 up, 0 in #解决 HEALTH_WARN 问题:mons are allowing insecure global_id reclaim问题: 禁用不安全模式:ceph config set mon auth_allow_insecure_global_id_reclaim false #扩容 mgr 节点 ceph-deploy mgr create <节点名称> 9、开启监控模块

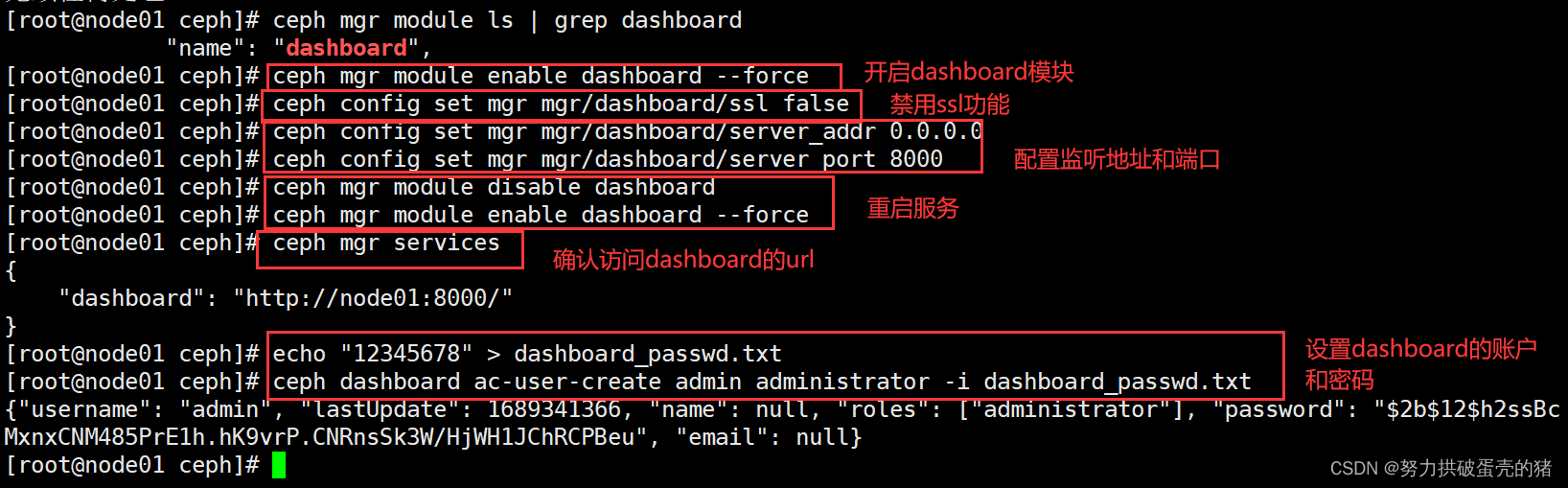

#在 ceph-mgr Active节点执行命令开启 ceph -s | grep mgr 主节点下载安装 yum install -y ceph-mgr-dashboard cd /etc/ceph ceph mgr module ls | grep dashboard #开启 dashboard 模块 ceph mgr module enable dashboard --force #禁用 dashboard 的 ssl 功能 ceph config set mgr mgr/dashboard/ssl false #配置 dashboard 监听的地址和端口 ceph config set mgr mgr/dashboard/server_addr 0.0.0.0 ceph config set mgr mgr/dashboard/server_port 8000 #重启 dashboard ceph mgr module disable dashboard ceph mgr module enable dashboard --force #确认访问 dashboard 的 url ceph mgr services #设置 dashboard 账户以及密码 echo "" > dashboard_passwd.txt ceph dashboard set-login-credentials admin -i dashboard_passwd.txt 或 ceph dashboard ac-user-create admin administrator -i dashboard_passwd.txt 用这个命令 浏览器访问:http://192.168.80.11:8000 ,账号密码为 admin/

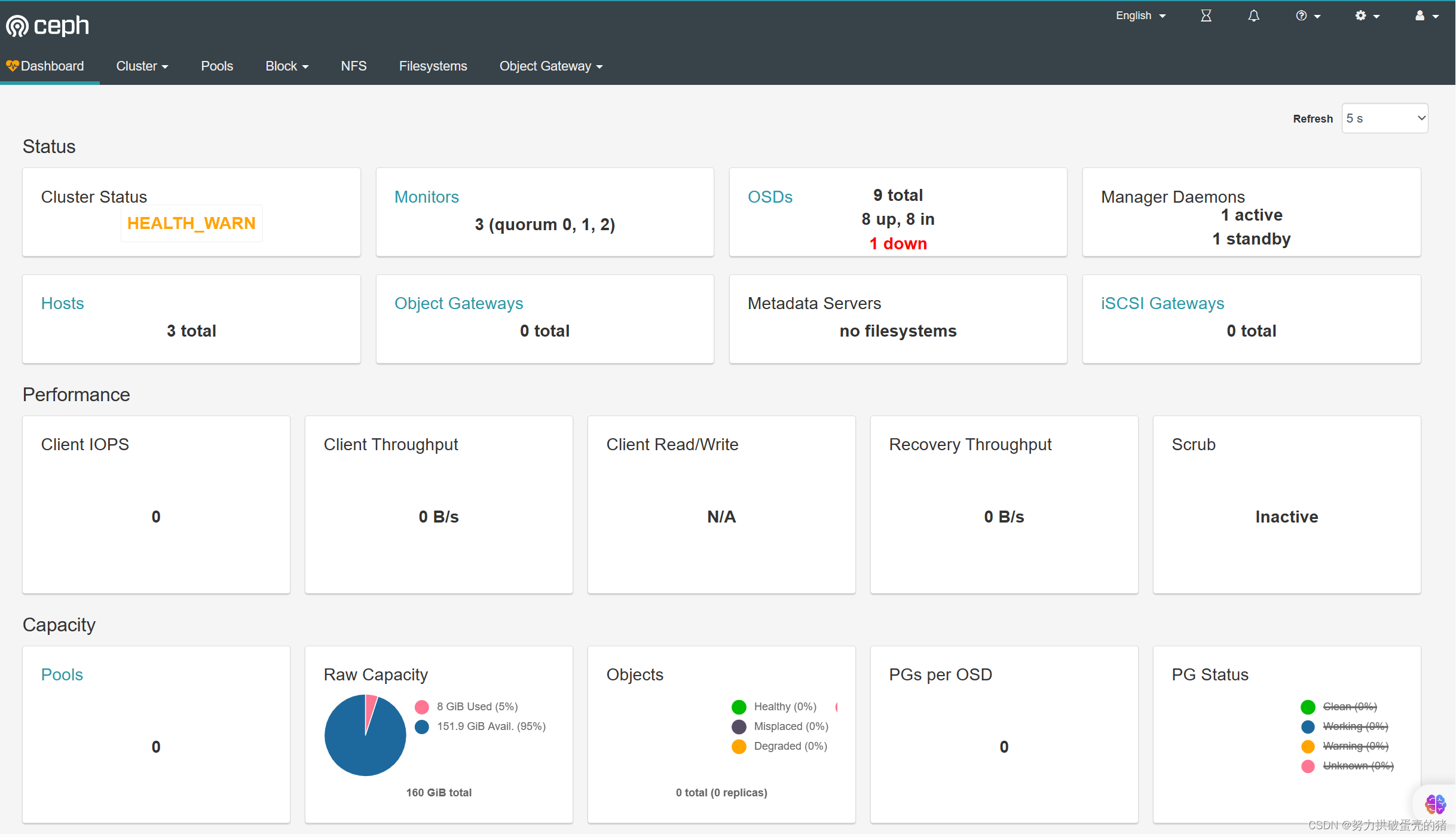

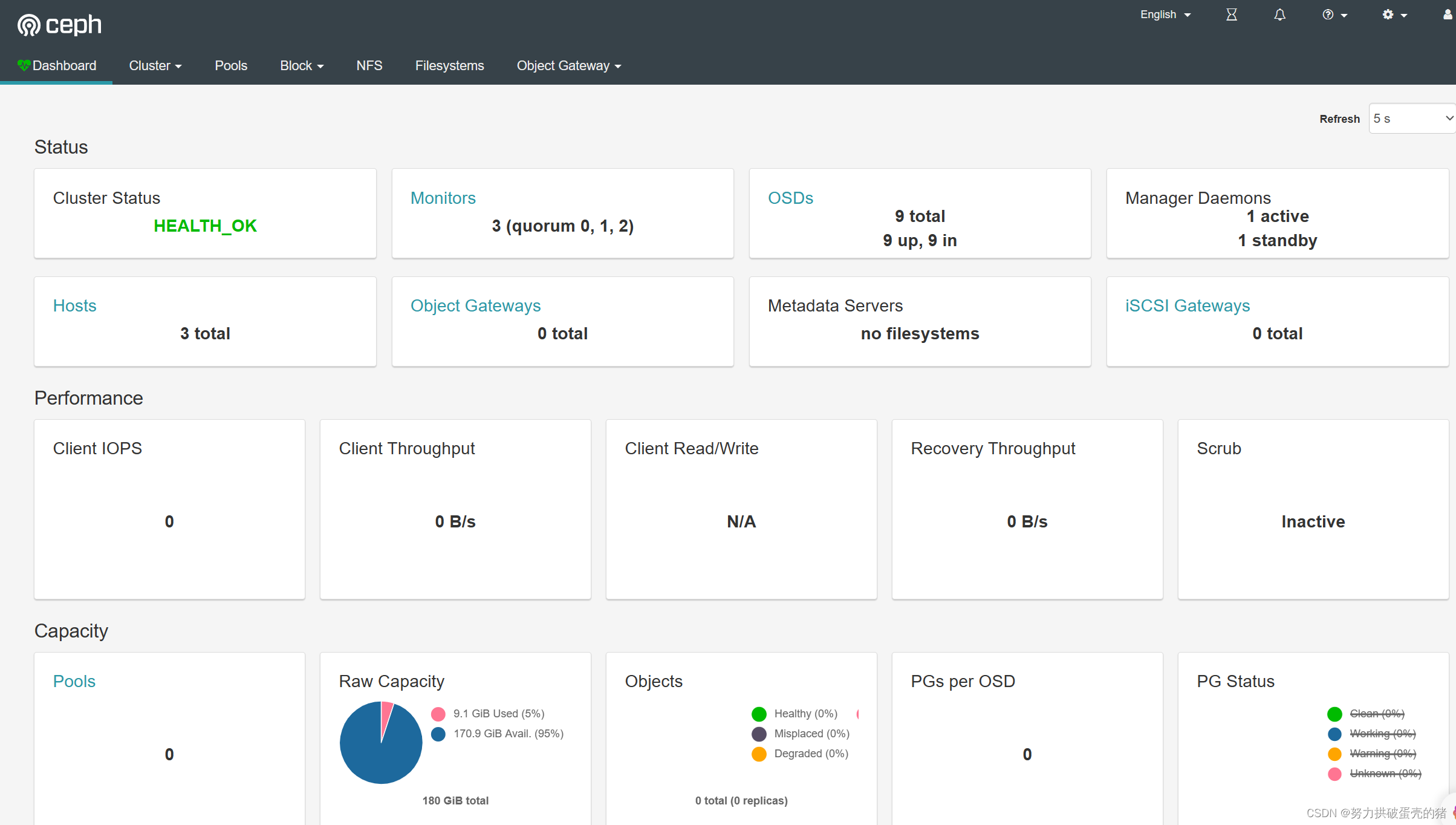

可以看到显示有一台osd down, 这是只需要重新配置一下时间同步,然后重启一下就好了

systemctl enable --now chronyd timedatectl set-ntp true #开启 NTP timedatectl set-timezone Asia/Shanghai #设置时区 chronyc -a makestep #强制同步下系统时钟 timedatectl status #查看时间同步状态 chronyc sources -v #查看 ntp 源服务器信息 timedatectl set-local-rtc 0 #将当前的UTC时间写入硬件时钟 #重启依赖于系统时间的服务 systemctl restart rsyslog systemctl restart crond #关闭无关服务 systemctl disable --now postfix 重启 reboot 重启mon(可选) systemctl restart ceph-mon.target五:资源池 Pool 管理

1、向 Ceph 中存储数据

2、创建 Pool 资源池–(增、查)

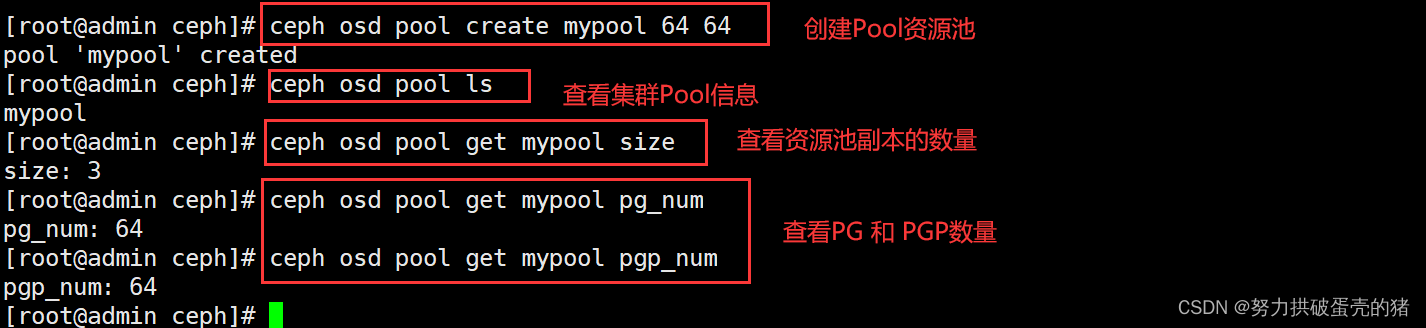

#创建一个 Pool 资源池,其名字为 mypool,PGs 数量设置为 64,设置 PGs 的同时还需要设置 PGP(通常PGs和PGP的值是相同的): PG (Placement Group),pg 是一个虚拟的概念,用于存放 object,PGP(Placement Group for Placement purpose),相当于是 pg 存放的一种 osd 排列组合 cd /etc/ceph ceph osd pool create mypool 64 64 #查看集群 Pool 信息 ceph osd pool ls 或 rados lspools ceph osd lspools #查看资源池副本的数量 ceph osd pool get mypool size #查看 PG 和 PGP 数量 ceph osd pool get mypool pg_num ceph osd pool get mypool pgp_num 3、 修改资源池信息–(修)

#修改 pg_num 和 pgp_num 的数量为 128 ceph osd pool set mypool pg_num 128 ceph osd pool set mypool pgp_num 128 ceph osd pool get mypool pg_num ceph osd pool get mypool pgp_num #修改 Pool 副本数量为 2 ceph osd pool set mypool size 2 ceph osd pool get mypool size 管理节点 #修改默认副本数为 2 vim ceph.conf ...... osd_pool_default_size = 2 ceph-deploy --overwrite-conf config push node01 node02 node03 4、删除 Pool 资源池–(删)

1)删除存储池命令存在数据丢失的风险,Ceph 默认禁止此类操作,需要管理员先在 ceph.conf 配置文件中开启支持删除存储池的操作 vim ceph.conf ...... [mon] mon allow pool delete = true 2)推送 ceph.conf 配置文件给所有 mon 节点 ceph-deploy --overwrite-conf config push node01 node02 node03 3)所有 mon 节点重启 ceph-mon 服务 systemctl restart ceph-mon.target 4)执行删除 Pool 命令 ceph osd pool rm pool01 pool01 --yes-i-really-really-mean-it 免责声明:本站所有文章内容,图片,视频等均是来源于用户投稿和互联网及文摘转载整编而成,不代表本站观点,不承担相关法律责任。其著作权各归其原作者或其出版社所有。如发现本站有涉嫌抄袭侵权/违法违规的内容,侵犯到您的权益,请在线联系站长,一经查实,本站将立刻删除。 本文来自网络,若有侵权,请联系删除,如若转载,请注明出处:https://haidsoft.com/112622.html