大家好,欢迎来到IT知识分享网。

今天给大家分享一个超强的算法模型,LSTM。LSTM是一种特殊的循环神经网络(RNN)算法,专门设计用来解决传统RNN在处理长序列数据时存在的梯度消失和梯度爆炸问题。

今天给大家分享一个超强的算法模型,LSTM。

LSTM(长短期记忆网络,Long Short-Term Memory)是一种特殊的循环神经网络(RNN)算法,专门设计用来解决传统RNN在处理长序列数据时存在的梯度消失和梯度爆炸问题。

它通过引入细胞状态和门控机制,使得模型能够捕捉和保存长期依赖信息,从而有效地处理序列数据中的长期依赖关系。

LSTM 广泛应用于自然语言处理、语音识别、时间序列预测等领域。

LSTM 的基本结构和原理

LSTM 的核心思想

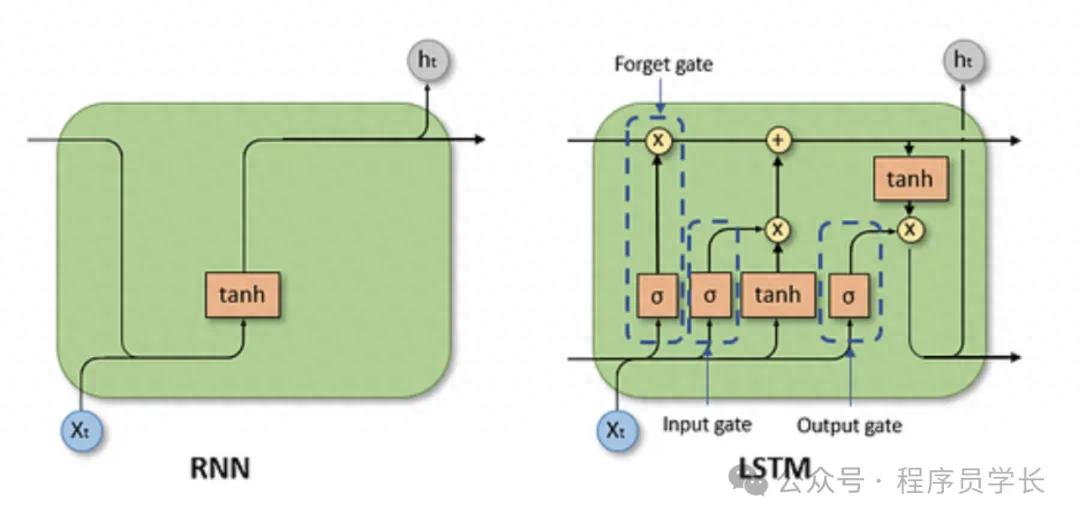

传统的 RNN 在处理长序列时,由于信息在时间步长上的反向传播,导致靠近输入端的梯度变得非常小或非常大,从而使得模型难以学习到长期依赖关系。

LSTM 的核心思想是通过引入门控机制来控制信息的流动,从而有效地“记住”重要的信息并“遗忘”不重要的信息,解决了长期依赖问题。

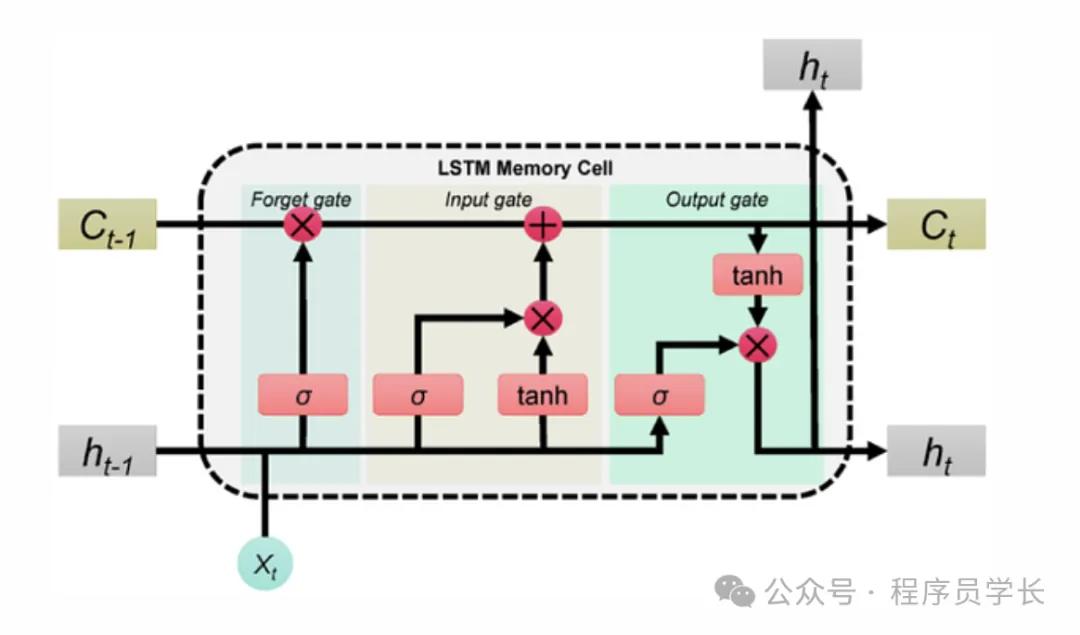

LSTM 单元内部包含一个细胞状态 (cell state),可以看作是信息流动的 “高速公路”,它直接穿过整个链条,只进行少量的线性交互。信息可以通过门控机制被添加到细胞状态或从中移除。

基本结构

LSTM 单元主要由以下几个部分组成。

- 细胞状态:这是 LSTM 的核心,可以看作是网络的 “记忆单元”。它能够沿着时间链传输信息,并且只受到门控单元的少量线性交互。

- 遗忘门:决定细胞状态中哪些信息需要被丢弃。

- 输入门:决定当前输入中哪些信息需要写入细胞状态。

- 输出门:决定当前细胞状态中哪些信息应该被输出。

通过这三个门的控制,LSTM 能够选择性地保留和丢弃信息,从而有效捕捉长期依赖。

LSTM 的数学公式

假设在时刻 t,输入为 xt,前一时刻隐藏状态为 ht-1,前一时刻细胞状态为 Ct-1。

LSTM 的计算过程如下

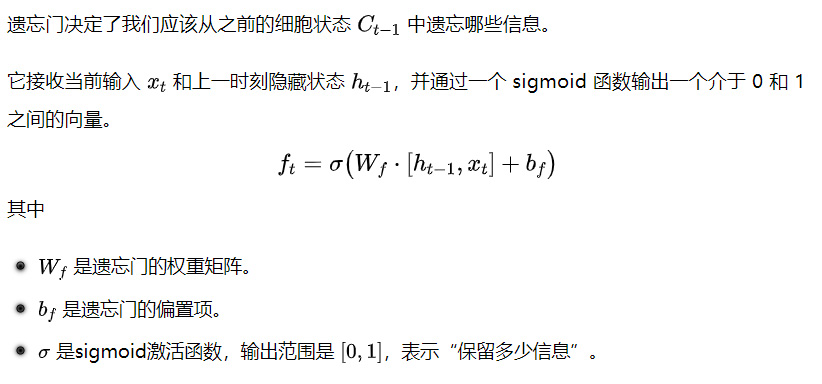

1.遗忘门

2.输入门

输入门决定了有多少新的信息要添加到细胞状态中。它包含两个部分:

这包括两个部分

- 输入门层

决定哪些值将被更新。

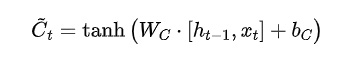

- 候选细胞状态

产生新的候选信息向量,准备加入到细胞状态中。

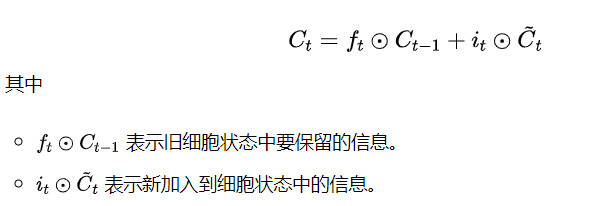

3.更新细胞状态

细胞状态结合遗忘门和输入门的结果进行更新。

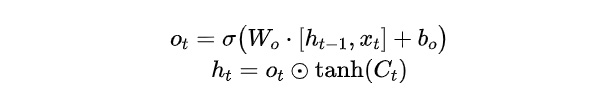

4.输出门

输出门决定了细胞状态中有哪些信息将被 “输出” 作为当前时间步的隐藏状态 ht。

LSTM 的优势

- 解决长期依赖问题:LSTM 能够有效地捕获和利用序列中远距离的依赖关系,这是其最显著的优势。

- 更好的梯度流动:门控机制确保了梯度在反向传播时能够更好地流动,缓解了梯度消失问题。

- 适用于各种序列任务:在语音识别、自然语言处理(机器翻译、文本生成、情感分析)、时间序列预测等领域表现出色。

案例分享

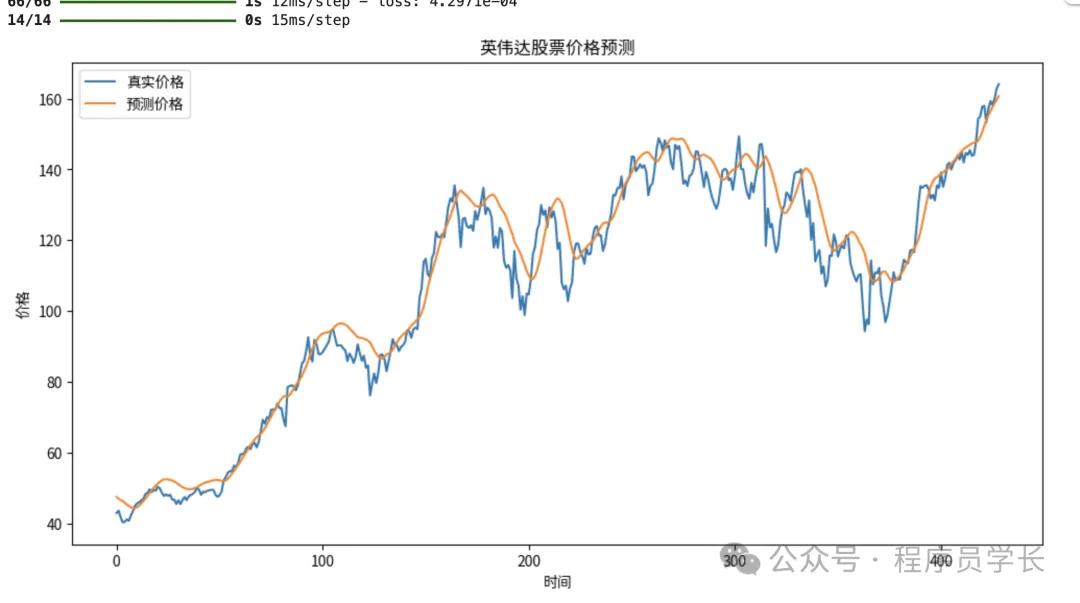

下面是一个使用 LSTM 算法预测英伟达(NVIDIA,股票代码NVDA)股票价格的示例代码。代码会用 Python 和 TensorFlow/Keras 实现,流程包括数据获取、预处理、模型构建、训练和预测。

import numpy as np import pandas as pd import matplotlib.pyplot as plt from sklearn.preprocessing import MinMaxScaler from tensorflow.keras.models import Sequential from tensorflow.keras.layers import LSTM, Dense import yfinance as yf # 1. 下载英伟达股票数据(近几年) ticker = 'NVDA' data = yf.download(ticker, start='2017-01-01', end='2025-07-11') print(data.head()) # 2. 只用收盘价进行预测 close_prices = data['Close'].values.reshape(-1, 1) # 3. 数据归一化,映射到[0,1] scaler = MinMaxScaler(feature_range=(0, 1)) scaled_data = scaler.fit_transform(close_prices) # 4. 创建训练集,时间步长设为60天(过去60天预测第61天) def create_dataset(dataset, time_step=60): X, Y = [], [] for i in range(len(dataset) - time_step): X.append(dataset[i:i+time_step, 0]) Y.append(dataset[i+time_step, 0]) return np.array(X), np.array(Y) time_step = 60 X, y = create_dataset(scaled_data, time_step) # 5. LSTM输入需要3D张量:[样本数, 时间步长, 特征数] X = X.reshape(X.shape[0], X.shape[1], 1) # 6. 构建LSTM模型 model = Sequential() model.add(LSTM(units=50, return_sequences=True, input_shape=(time_step, 1))) model.add(LSTM(units=50, return_sequences=False)) model.add(Dense(units=25)) model.add(Dense(units=1)) model.compile(optimizer='adam', loss='mean_squared_error') # 7. 训练模型 model.fit(X, y, batch_size=32, epochs=10) # 8. 预测示例:用训练数据后部分做预测演示 train_size = int(len(scaled_data) * 0.8) test_data = scaled_data[train_size - time_step:] X_test, y_test = create_dataset(test_data, time_step) X_test = X_test.reshape(X_test.shape[0], X_test.shape[1], 1) predictions = model.predict(X_test) predictions = scaler.inverse_transform(predictions) # 9. 可视化结果 actual_prices = scaler.inverse_transform(y_test.reshape(-1,1)) plt.figure(figsize=(12,6)) plt.plot(actual_prices, label='真实价格') plt.plot(predictions, label='预测价格') plt.title('英伟达股票价格预测') plt.xlabel('时间') plt.ylabel('价格') plt.legend() plt.show()

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

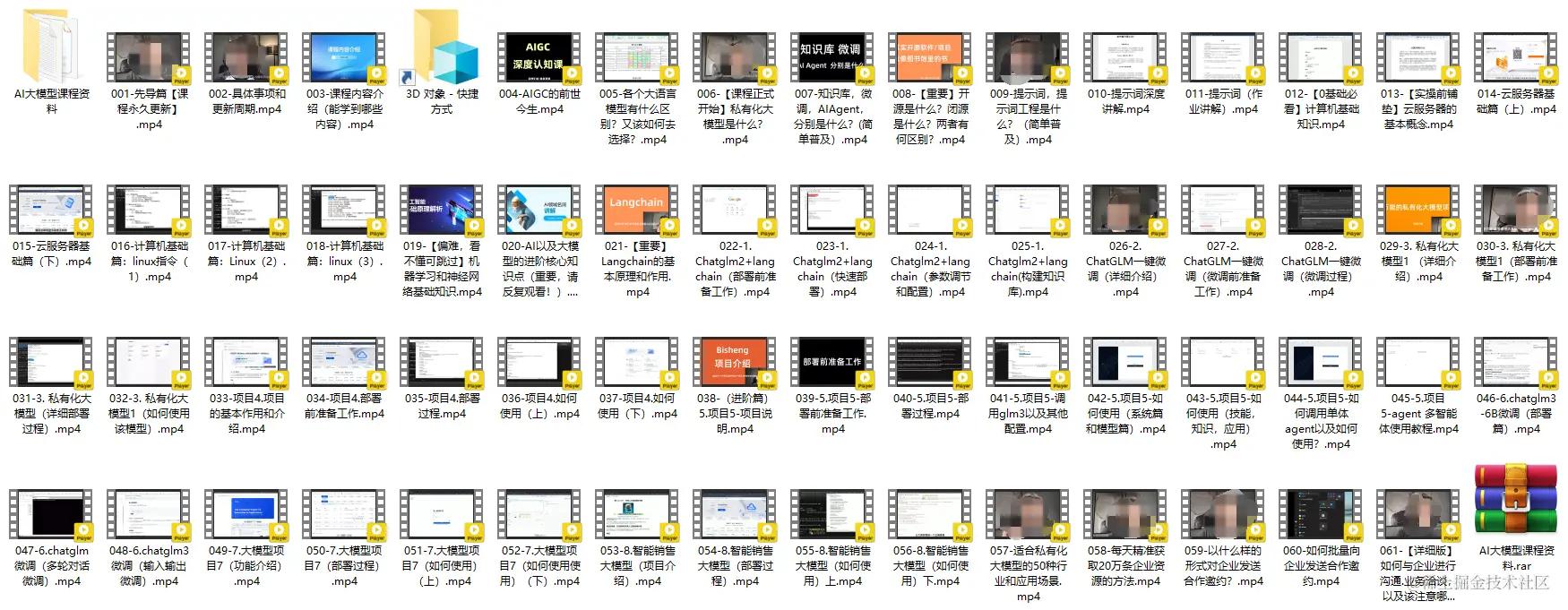

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

LLM大模型学习路线↓

阶段1:AI大模型时代的基础理解

- 目标:了解AI大模型的基本概念、发展历程和核心原理。

- 内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

- 目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

- 内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

- 目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

- 内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

- 目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

- 内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等

有需要的小伙伴,可以私信小编【大模型】领取哦!

免责声明:本站所有文章内容,图片,视频等均是来源于用户投稿和互联网及文摘转载整编而成,不代表本站观点,不承担相关法律责任。其著作权各归其原作者或其出版社所有。如发现本站有涉嫌抄袭侵权/违法违规的内容,侵犯到您的权益,请在线联系站长,一经查实,本站将立刻删除。 本文来自网络,若有侵权,请联系删除,如若转载,请注明出处:https://haidsoft.com/184741.html