大家好,欢迎来到IT知识分享网。

ELU

指数线性单元(ELU),全称Exponential Linear Units,使用了指数作为激活函数的一部分。

函数表达式

f ( x ) = { α ( e x − 1 ) , x ≤ 0 x , x > 0 f(x)=\begin{cases} \alpha (e^x-1),\quad x\leq 0\\ x, \quad x>0 \end{cases} f(x)={

α(ex−1),x≤0x,x>0

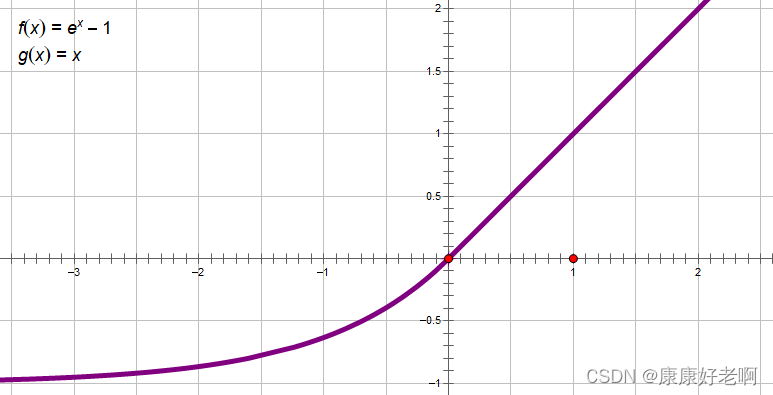

函数图像

在图像上, x > 0 x>0 x>0部分与ReLU相似,而在 x < 0 x<0 x<0部分与sigmoid/tanh相似

函数特性

ELU激活函数上所有点都是连续且可微的( α = 1 \alpha =1 α=1),所以不存在梯度消失和梯度爆炸的问题。ELU在 x > 0 x>0 x>0部分与ReLU相似,而在 x < 0 x<0 x<0部分与sigmoid/tanh相似,这样就能很好的结合两者的优点。理论上,ELU要好于ReLU,但是实际上,并没有证据表明ELU总是优于ReLU。

优点:

- 相比于ReLU、sigmoid、tanh激活函数,其训练时间更短、精确度也更高。因为其在原点处函数连续,这样能够加快函数收敛

- 没有dead relu神经元死亡问题

缺点:

- 计算速度较慢,因为涉及到非线性的运算,但是其较快的收敛速度会对其进行一定程度上的弥补

的弥补

免责声明:本站所有文章内容,图片,视频等均是来源于用户投稿和互联网及文摘转载整编而成,不代表本站观点,不承担相关法律责任。其著作权各归其原作者或其出版社所有。如发现本站有涉嫌抄袭侵权/违法违规的内容,侵犯到您的权益,请在线联系站长,一经查实,本站将立刻删除。 本文来自网络,若有侵权,请联系删除,如若转载,请注明出处:https://haidsoft.com/134166.html