大家好,欢迎来到IT知识分享网。

Gradient Reversal Layer指什么? – 知乎 (zhihu.com)

grl的作用:(创建一个对抗性的训练机制)

梯度反转层(GRL,Gradient Reversal Layer)是用于域自适应和对抗性训练中的一种关键技术。其作用在于创建一个对抗性的训练机制,使得特征提取器学习到的特征能够更好地适应目标领域的数据分布。

解决域适应的两类方法:

1.对已经提取的特征进行处理

通过特征转换或特征选择等方式,将源域和目标域的特征进行对齐或者调整,使得它们在特征空间中更加相似。这种方法通常被归类为基于实例的方法,因为它们直接操作特征空间中的实例。

2.研究如何提取满足域适应的特征

这类方法主要关注于如何设计或学习一个特征提取器,使其能够在源域和目标域上提取出具有良好泛化能力的特征表示。这些方法通常被归类为基于模型的方法,因为它们涉及训练一个可以同时处理源域和目标域数据的模型,其中包括了特征提取器和分类器等组件。

grl作用的实现:

使用上述第二种方法:在解决域自适应问题时,如果使用源域的数据训练模型,把该模型直接用在目标域上,肯定效果是不好的,所以我们使用上述所说的第二种方法,提取一个能够在源域和目标域都适应的特征。

实现:

交代图中信息:

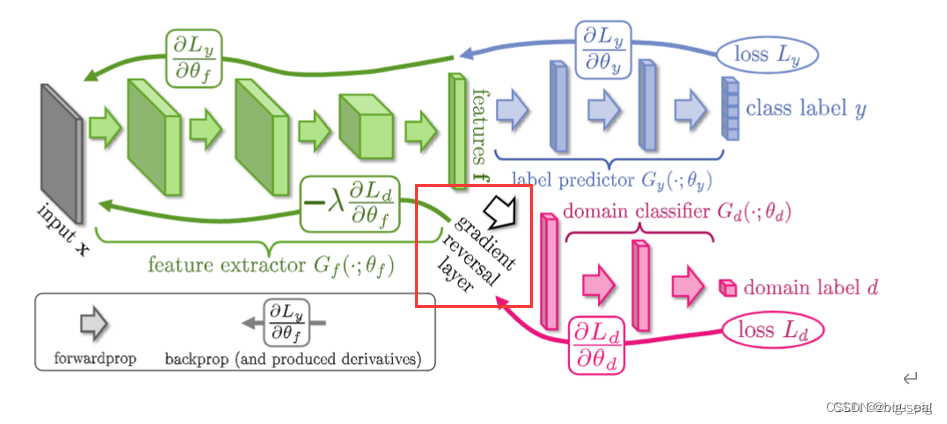

先不看GRL部分,input x,经过特征提取得到特征表示,使用这个表示,进一步的分类,上面一类是模型主要的分类任务(eg:谣言检测中的新闻是真还是假),下面一类是说这个x来自于哪个领域,是原领域还是要检测的目标域。很明显在使用grl之前,需要有3个模块:一个提取器,域分两类器,还有一个主任务分类器(eg:谣言检测的detector)

再看外圈的小箭头,分别是一堆梯度,grl就是梯度反转层,其中翻转的梯度是Ld对θf,即域分类的损失对于特征提取模块参数的梯度。

域分类器的分类效果用域分类损失Ld来表示,提取器提取特征的模糊程度可以间接的使用主任务的分类损失Ly表示。Ld调整的是域分类器的参数,Ly调整的是提取器的参数。

实现思路:

通过提取器和域分类器的对抗学习,提取一个满足域自适应的特征。对抗双方:我们希望提取器提取出来的特征变得不容易被被域分类器分类出来,同时希望域分类器的分类效果变好。

实现流程:(以谣言检测为例)

预训练:先准备三个已经完成的预训练模块,提取器和主任务分类器(谣言检测的detector)使用源域的数据集预训练,域分类器使用源域和部分目标域数据集

三个模块的训练目的:接下来要使用grl,让提取器提取出的特征域模糊;其中域分类器的作用是与提取器形成对抗训练;让detector检测谣言效果好

预训练时没有grl的参与,预训练结束,把grl插入到提取器和域分类器中间,参与后向传播对模型进行调整。grl构建一个对抗训练,达到调整模型的目的,提取器努力让特征域模糊,模糊程度用主任务损失来标量(特征越模糊,目标域上的检测效果越好,detector损失越小);域分类器努力发挥职责,优化效果使用域分类损失标量,不断的减小域分类器的损失帮助对抗训练和主任务的损失直接显示对抗训练效果,特征变得越来越域模糊。

免责声明:本站所有文章内容,图片,视频等均是来源于用户投稿和互联网及文摘转载整编而成,不代表本站观点,不承担相关法律责任。其著作权各归其原作者或其出版社所有。如发现本站有涉嫌抄袭侵权/违法违规的内容,侵犯到您的权益,请在线联系站长,一经查实,本站将立刻删除。 本文来自网络,若有侵权,请联系删除,如若转载,请注明出处:https://haidsoft.com/152346.html