大家好,欢迎来到IT知识分享网。

点击下方卡片,关注“自动驾驶之心”公众号

戳我-> 领取自动驾驶近15个方向学习路线

写在前面&笔者的个人理解

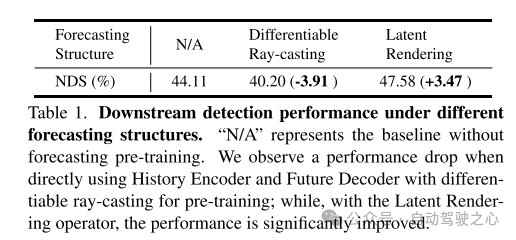

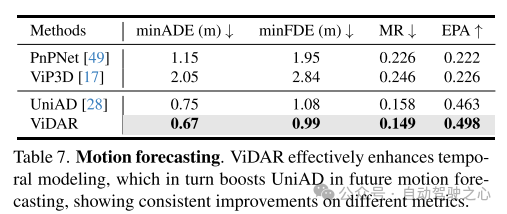

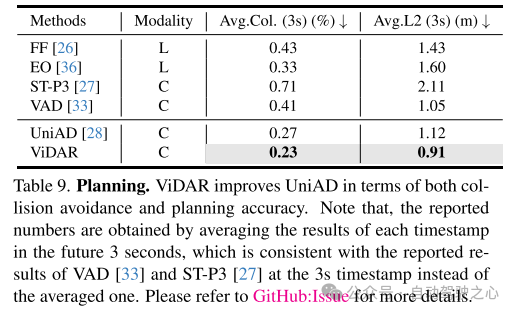

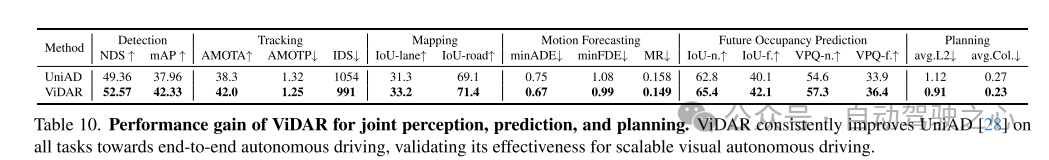

与广泛研究的通用视觉(general vision)不同,针对可扩展视觉自动驾驶(scalable visual autonomous driving)的预训练仍然很少被探索。视觉自动驾驶应用需要同时包含语义、三维几何和时间信息的特征,用于联合感知、预测和规划,这给预训练带来巨大挑战。为了解决这一问题,本文提出了一种新的预训练任务,称为视觉点云预测(visual point cloud forecasting)——从历史视觉输入(historical visual input)预测未来的点云。这项任务的关键优势在于它能够协同学习语义、三维结构和时间动态。因此,它在各种下游任务中显示出了优越性。为了应对这一新问题,本文提出了 ViDAR,这是一个预训练下游视觉编码器的通用模型。它首先通过编码器提取历史嵌入(historical embeddings)表示。然后,这些表示通过一个新颖的潜在渲染操作符(Latent Rendering operator)被转换到三维几何空间,以进行未来点云的预测。实验表明,在下游任务中取得了显著的提升,例如,在三维检测中NDS提高了3.1%,在运动预测中的误差减少了约10%,在规划中的碰撞率减少了约15%。

ViDAR的论文设计

近期,社区见证了以视觉或仅相机为输入的自动驾驶的快速发展,输入数据为单目或多视角图像。仅利用视觉输入,现有方法展示了提取鸟瞰图(Bird’s-Eye-View, BEV)特征的卓越能力,并在感知、预测和规划方面表现良好。尽管在应用中取得了显著的进步,这些模型在很大程度上依赖于精确的三维标注,而这些标注往往难以收集,例如语义占用、3D boxes、轨迹,因此在生产中难以扩展(scale up)。

考虑到昂贵的标注工作流程,预训练已经成为扩展(scale up)下游应用的关键方法。核心思想是定义借助大量现成数据的 pretext tasks 来学习有意义的表示。这种方法可以提升下游任务的性能,即使标注数据有限也能发挥作用。

尽管在计算机视觉领域已经进行了广泛的预训练研究,其在视觉自动驾驶中的应用还鲜有探索。视觉自动驾驶在预训练方面提出了巨大挑战,因为它要求特征同时保持语义、三维几何和时间动态,以便于联合感知、预测和规划。因此,大多数模型仍然依赖于有监督的预训练,比如三维检测或占用,使用的是往往无法大规模获取的标注数据。一些方法提出估算深度或渲染掩码场景(rendering masked scenes)作为预训练手段。它们使用图像-激光雷达对(Image-LiDAR pairs)作为实现可扩展的无标注预训练的手段。然而,它们在多视角三维几何或时间建模方面存在困难(见图2)。深度估计从单个图像中提取深度信息,但在多视角几何中受限;渲染技术从多视角图像重建场景,但缺乏时间建模。然而,在端到端自动驾驶系统中,时间建模至关重要,例如UniAD,尤其是对于预测和规划这些最终目标,它们需要准确的场景流(scene flow)和物体运动来进行决策。由于缺乏时间建模,现有方法对于预训练端到端系统来说还不够充分。

在这项工作中,本文探索了专为端到端视觉自动驾驶应用量身定制的预训练方法,不仅包括感知,还包括预测和规划。本文构建了一个新的 pretext tasks ——视觉点云预测(见图2),以充分利用原始图像-激光雷达序列背后的语义、三维几何和时间动态信息,并考虑到可扩展性(being scalable)。它从历史视觉图像中预测未来的点云。

视觉点云预测的主要理念在于对语义、三维结构和时间建模的同时监督。通过迫使模型从历史数据预测未来,它监督了场景流和物体运动的提取,这对于时间建模和未来估计至关重要。同时,它涉及从图像重建点云,这监督了多视角几何和语义建模。因此,来自视觉点云预测的特征嵌入了几何和时间提示(geometric and temporal hints)的信息,这对于同时进行感知、跟踪和规划都是有益的。

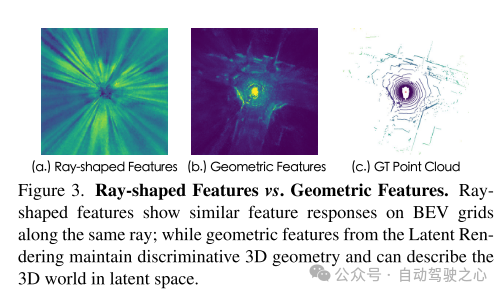

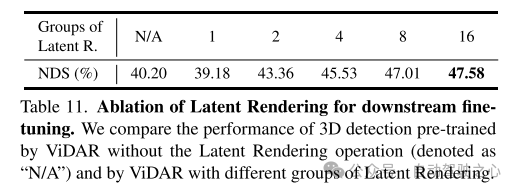

为此,本文提出了 ViDAR,一种用于预训练的通用视觉点云预测方法(a general visual point cloud forecasting approach)(见图2)。ViDAR 包括三个部分:历史编码器(History Encoder)、潜在渲染操作符(Latent Rendering operator)和未来解码器(Future Decoder)。历史编码器是预训练的目标结构。它可以是任何视觉BEV编码器,用于将视觉序列嵌入到BEV空间。这些BEV特征被送入潜在渲染操作符。潜在渲染在使 ViDAR 提升下游性能方面发挥着至关重要的作用。它解决了 射线形状BEV特征问题(ray-shaped BEV features issue),建模三维几何潜在空间,并连接编码器与解码器。未来解码器是一个自回归 transformer ,它利用历史BEV特征迭代地预测任意时间戳的未来点云。

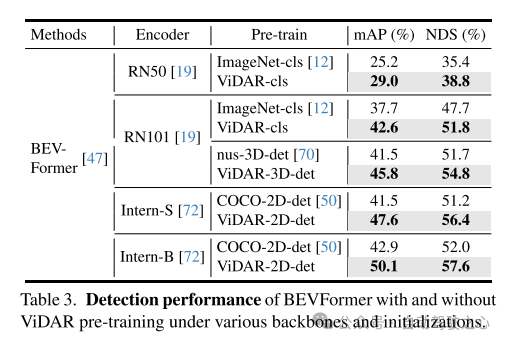

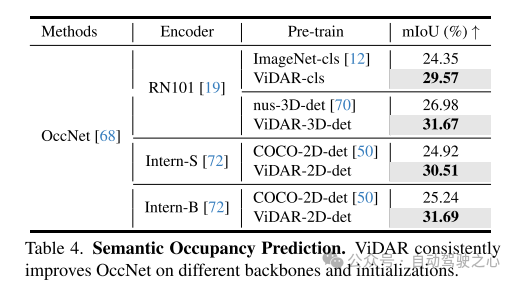

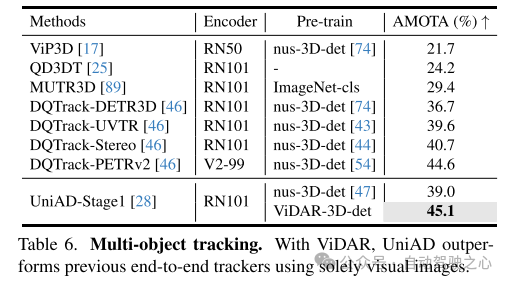

ViDAR 为视觉自动驾驶预训练提供了一个全面的解决方案。本文在 nuScenes 数据集上测试了 ViDAR,包括点云预测和下游验证。尽管使用的是视觉输入,ViDAR在点云预测方面仍然超过了使用点云的先前预测方法,对于1秒后未来的点云估计,Chamfer Distance 减少了约33%。ViDAR 也提高了下游性能。仅使用图像-激光雷达序列,ViDAR出人意料地超过了3D检测预训练,例如,在相同数据规模下,检测的mAP提高了1.1%,语义占用预测的mIoU提高了2.5%。如果也基于3D检测预训练,ViDAR将先前方法的mAP提高了4.3%,mIoU提高了4.6%。此外,由于在几何和时间信息的联合捕获上进行了有效的预训练,ViDAR在所有端到端自动驾驶任务上都显著提升了UniAD的性能,包括感知、预测和规划(见图1)。实验结果验证了视觉点云预测能够实现可扩展的自动驾驶(scalable autonomous driving)。

图1. ViDAR 是一个视觉自动驾驶预训练框架,它利用从历史视觉输入中估计未来点云作为 pretext tasks 。本文将这种新的 pretext tasks 称为视觉点云预测(visual point cloud forecasting)。在 ViDAR 的帮助下,本文在感知、预测和规划的多种下游应用中取得了显著的改进。

图2. 视觉自动驾驶预训练范式以及本文的 ViDAR 架构之间的比较。与现有方法相比,视觉点云预测共同建模了多视角几何和时间动态。然后本文提出了 ViDAR,使用图像-激光雷达序列来预训练视觉编码器。

图3. 射线形状特征(Ray-shaped Features)与几何特征。射线形状特征在同一射线上的BEV网格中显示出相似的特征响应;而来自潜在渲染的几何特征保持了区分性的三维几何形状,并且能够在潜在空间中描述三维世界。

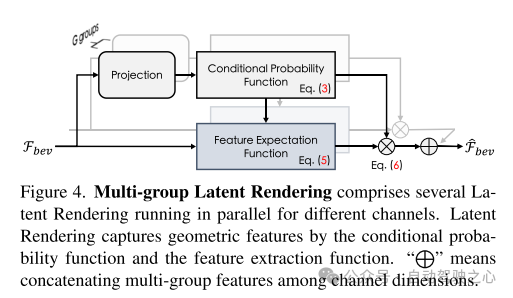

图4. 多组潜在渲染包括几个并行运行的潜在渲染,用于不同的通道。潜在渲染通过条件概率函数和特征提取函数来捕获几何特征。

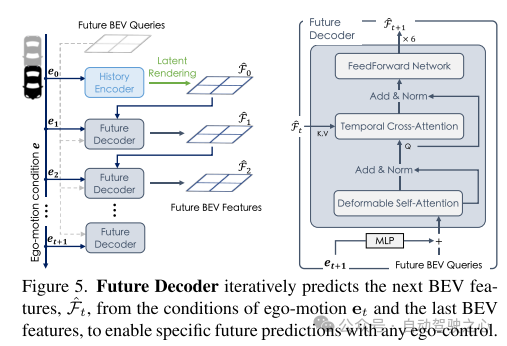

图5. 未来解码器。

实验结果

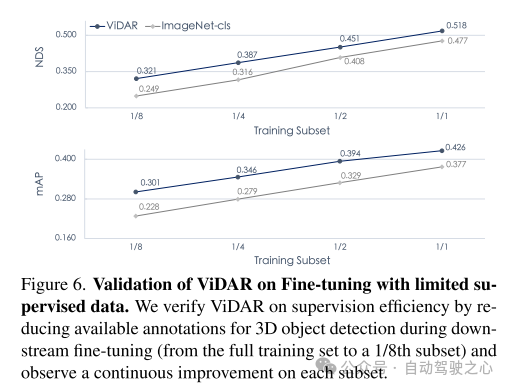

图6. 在有限监督数据上对 ViDAR 进行微调的验证。本文通过在下游微调过程中减少可用的三维目标检测标注(从完整训练集到1/8的子集)来验证 ViDAR 在监督效率上的表现,并观察到在每个子集上的持续改进。

总结

本文介绍了视觉点云预测(visual point cloud forecasting),这是一种从历史视觉图像预测未来点云的新型端到端自动驾驶预训练任务。本文开发了 ViDAR,一个用于预训练视觉BEV编码器的通用模型,并设计了一个潜在渲染操作符来解决射线形状特征问题。总之,本文的工作证明了视觉点云预测能够实现可扩展的自动驾驶(scalable autonomous driving)

投稿作者为『自动驾驶之心知识星球』特邀嘉宾,欢迎加入交流!

① 全网独家视频课程

BEV感知、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、大模型与自动驾驶、Nerf、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

网页端官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

国内最大最专业,近2700人的交流社区,已得到大多数自动驾驶公司的认可!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(2D/3D检测、语义分割、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型、端到端等,更有行业动态和岗位发布!欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦2D/3D目标检测、语义分割、车道线检测、目标跟踪、BEV感知、多模态感知、Occupancy、多传感器融合、transformer、大模型、在线地图、点云处理、端到端自动驾驶、SLAM与高精地图、深度估计、轨迹预测、NeRF、Gaussian Splatting、规划控制、模型部署落地、cuda加速、自动驾驶仿真测试、产品经理、硬件配置、AI求职交流等方向。扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】平台矩阵,欢迎联系我们!

免责声明:本站所有文章内容,图片,视频等均是来源于用户投稿和互联网及文摘转载整编而成,不代表本站观点,不承担相关法律责任。其著作权各归其原作者或其出版社所有。如发现本站有涉嫌抄袭侵权/违法违规的内容,侵犯到您的权益,请在线联系站长,一经查实,本站将立刻删除。 本文来自网络,若有侵权,请联系删除,如若转载,请注明出处:https://haidsoft.com/156213.html